Start-up i AI zbulon avatarë që tregojnë bindshëm emocionet njerëzore

Kjo e bën të duket sikur po vdes, por është e kundërta. Në një farë mënyre, jam gati të jetoj përgjithmonë, falë startup-it të videove të inteligjencës artificiale Synthesia. Për disa vitet e fundit, kompania ka prodhuar avatarë të gjeneruar nga AI, por sot ajo lançon një gjeneratë të re, e para që përfiton nga përparimet më të fundit në AI gjeneruese, dhe ato janë më realiste dhe ekspresive se çdo gjë që kam parë ndonjëherë. Ndërsa publikimi i sotëm do të thotë se pothuajse çdokush tani do të jetë në gjendje të bëjë një dyshe dixhitale, në këtë pasdite të fillimit të prillit, përpara se teknologjia të dalë publike, ata kanë rënë dakord të bëjnë një prej meje.

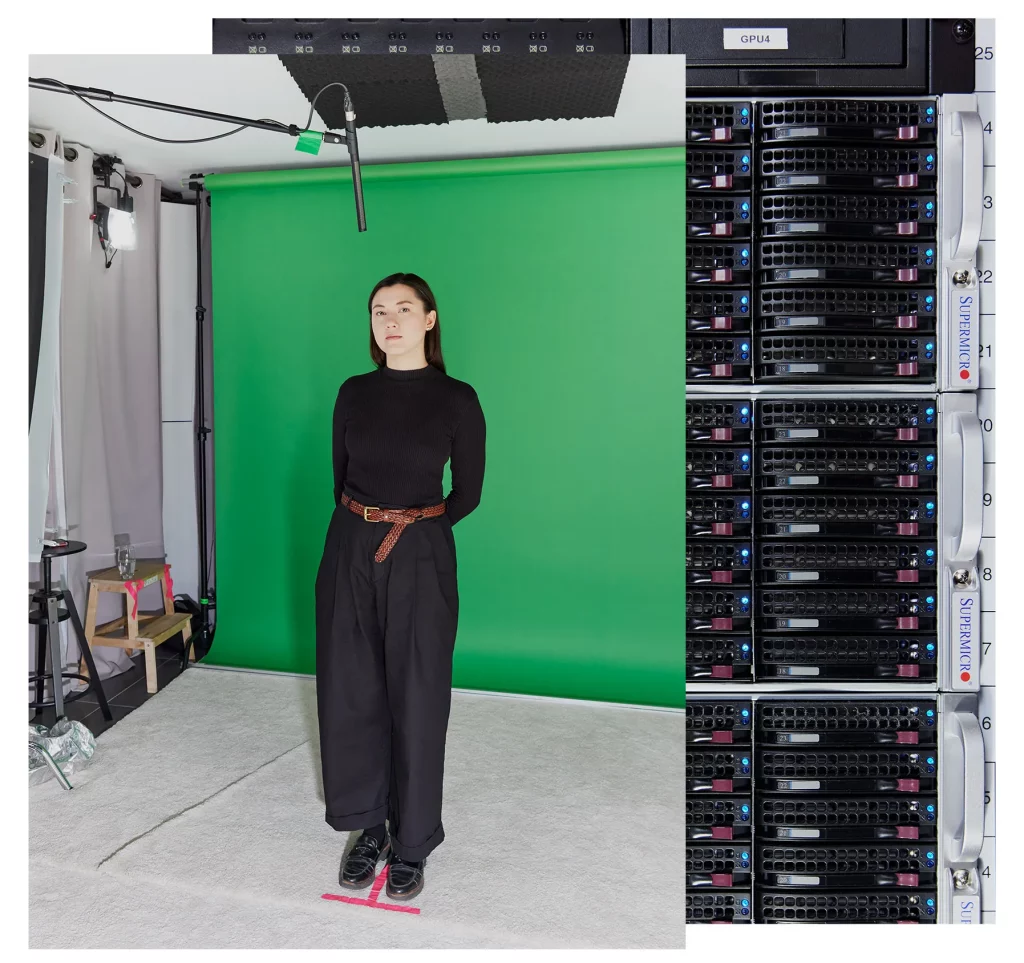

Kur më në fund mbërrij në studion elegante të kompanisë në Londrën Lindore, më përshëndet Tosin Oshinyemi, drejtuesi i prodhimit të kompanisë. Ai do të më drejtojë dhe drejtojë gjatë procesit të mbledhjes së të dhënave – dhe me “mbledhjen e të dhënave”, nënkuptoj kapjen e tipareve të mia të fytyrës, sjelljeve dhe më shumë – njësoj siç bën zakonisht për aktorët dhe klientët e Synthesia.

Ai më prezanton me një stilist në pritje dhe një grimier dhe unë mallkoj veten që kam humbur kaq shumë kohë duke u përgatitur. Detyra e tyre është të sigurojnë që njerëzit të kenë ato lloj veshjesh që duken mirë në kamera dhe që ato të duken të qëndrueshme nga një shkrepje në tjetrën. Stilistja më thotë se veshja ime është në rregull (phew), dhe grimieri më prek fytyrën dhe rregullon flokët e mi të bebes. Dhoma e zhveshjes është e zbukuruar me qindra polaroidë të buzëqeshur të njerëzve që janë klonuar në mënyrë dixhitale para meje.

Përveç superkompjuterit të vogël që rrotullohet në korridor, i cili përpunon të dhënat e gjeneruara në studio, kjo ndjehet më shumë si të hysh në një studio lajmesh sesa të hysh në një fabrikë të falsifikimit të thellë.

Bëj shaka që Oshinyemi ka atë që MIT Technology Review mund ta quajë një titull pune të së ardhmes : “Drejtor i krijimit të rreme të thellë”.

“Ne na pëlqen termi ‘media sintetike’ në krahasim me ‘deepfake’,” thotë ai.

Është një ndryshim delikate, por, disa do të argumentonin, ndryshim i dukshëm në semantikë. Të dyja nënkuptojnë video të krijuara nga AI ose regjistrime audio të njerëzve që bëjnë ose thonë diçka që nuk ka ndodhur domosdoshmërisht në jetën reale. Por “deepfakes” kanë një reputacion të keq. Që nga fillimi i tyre gati një dekadë më parë, termi ka ardhur për të sinjalizuar diçka joetike, thotë Alexandru Voica, kreu i çështjeve të korporatave dhe politikave të Synthesia. Mendoni për përmbajtjet seksuale të prodhuara pa pëlqim, ose fushatat politike që përhapin dezinformata ose propagandë.

“Media sintetike është versioni më i mirë dhe produktiv i kësaj,” argumenton ai. Dhe Synthesia dëshiron të ofrojë versionin më të mirë të atij versioni.

Deri më tani, të gjitha videot e njerëzve të krijuara nga AI kanë prirur të kenë disa ngurtësi, defekte ose elementë të tjerë të panatyrshëm që i bëjnë ato mjaft të lehta për t’u dalluar nga realiteti. Për shkak se janë shumë afër gjësë reale, por jo plotësisht , këto video mund t’i bëjnë njerëzit të ndihen të mërzitur, të shqetësuar ose të acaruar—një fenomen i njohur zakonisht si lugina e çuditshme. Synthesia pretendon se teknologjia e saj e re më në fund do të na nxjerrë jashtë luginës.

Falë përparimeve të shpejta në inteligjencën artificiale gjeneruese dhe një sërë të dhënash trajnimi të krijuara nga aktorët njerëzorë që janë futur në modelin e saj të AI, Synthesia ka qenë në gjendje të prodhojë avatarë që janë me të vërtetë më njerëzor dhe më ekspresivë se paraardhësit e tyre. Klonet dixhitale janë më të aftë të përputhen me reagimet dhe intonacionin e tyre me ndjenjën e skenarëve të tyre – duke vepruar më optimistë kur flasin për gjëra të lumtura, për shembull, dhe më seriozë ose të trishtuar kur flasin për gjëra të pakëndshme. Ata gjithashtu bëjnë një punë më të mirë në përputhje me shprehjet e fytyrës – lëvizjet e vogla që mund të flasin për ne pa fjalë.

Por ky përparim teknologjik sinjalizon gjithashtu një ndryshim shumë më të madh social dhe kulturor. Gjithnjë e më shumë, aq shumë nga ato që shohim në ekranet tona gjenerohen (ose të paktën ndërrohen) nga AI, dhe po bëhet gjithnjë e më e vështirë të dallosh atë që është e vërtetë nga ajo që nuk është. Kjo kërcënon besimin tonë në gjithçka që shohim, e cila mund të ketë pasoja shumë reale, shumë të rrezikshme.

“Mendoj se mund të na duhet të themi lamtumirë për të zbuluar të vërtetën në një mënyrë të shpejtë,” thotë Sandra Wachter, një profesore në Institutin e Internetit të Oksfordit, e cila hulumton implikimet ligjore dhe etike të AI. “Ideja që thjesht mund të gjesh diçka në Google shpejt dhe të dish se çfarë është fakt dhe çfarë është trillim – nuk mendoj se funksionon më kështu.”

Kështu, ndërsa isha i emocionuar që Synthesia të bënte dyfishin tim dixhital, gjithashtu pyesja veten nëse dallimi midis mediave sintetike dhe deepfakes është thelbësisht i pakuptimtë. Edhe nëse i pari përqendron qëllimin e një krijuesi dhe, në mënyrë kritike, pëlqimin e një subjekti, a ka vërtet një mënyrë për të bërë avatarët e AI në mënyrë të sigurt nëse rezultati përfundimtar është i njëjtë? Dhe a duam vërtet të dalim nga lugina e çuditshme nëse kjo do të thotë se nuk mund ta kuptojmë më të vërtetën?

Por më urgjentisht, ishte koha për të zbuluar se si është të shohësh një version post-të vërtetë të vetes.

Një muaj para udhëtimit tim në studio, vizitova CEO të Synthesia Victor Riparbelli në zyrën e tij pranë Oxford Circus. Siç tregon Riparbelli, historia e origjinës së Synthesia-s buron nga përvojat e tij duke eksploruar muzikën tekno avangarde, geeky ndërsa rritej në Danimarkë. Interneti e lejoi atë të shkarkonte softuer dhe të prodhonte këngët e tij pa blerë sintetizues të shtrenjtë.

“Unë jam një besimtar i madh për t’u dhënë njerëzve aftësinë për t’u shprehur në mënyrën që munden, sepse mendoj se kjo siguron një botë më meritokratike,” më thotë ai.

Ai pa mundësinë për të bërë diçka të ngjashme me videon kur hasi në kërkime për përdorimin e të mësuarit të thellë për të transferuar shprehjet nga një fytyrë njerëzore në tjetrën në ekran.

“Ajo që shfaqi ishte hera e parë që një rrjet i të mësuarit të thellë mund të prodhonte korniza video që dukeshin dhe dukeshin reale,” thotë ai.

Ky hulumtim u krye nga Matthias Niessner, një profesor në Universitetin Teknik të Mynihut, i cili bashkëthemeloi Synthesia me Riparbelli në 2017, së bashku me profesorin e Kolegjit Universitar të Londrës, Lourdes Agapito dhe Steffen Tjerrild, me të cilët Riparbelli kishte punuar më parë në një projekt kriptomonedhe.

Fillimisht kompania ndërtoi mjete për sinkronizimin dhe dublimin e buzëve për industrinë e argëtimit, por zbuloi se shiriti për cilësinë e kësaj teknologjie ishte shumë i lartë dhe nuk kishte shumë kërkesa për të. Synthesia ndryshoi drejtim në vitin 2020 dhe lançoi gjeneratën e parë të avatarëve të AI për klientët e korporatave. Ai strumbullar u shpërblye. Në vitin 2023, Synthesia arriti statusin e njëbrirëshit, që do të thotë se vlerësohej në mbi 1 miliard dollarë, duke e bërë atë një nga kompanitë relativisht të pakta evropiane të AI që e bëjnë këtë.

Gjenerata e parë e avatarëve dukej e ngathët, me lëvizje të paqarta dhe me pak ndryshime. Përsëritjet e mëvonshme filluan të dukeshin më njerëzore, por ata ende përpiqeshin të thoshin fjalë të ndërlikuara dhe gjërat ishin pak të sinkronizuara.

Sfida është se njerëzit janë mësuar të shikojnë fytyrat e njerëzve të tjerë. “Ne si njerëz e dimë se çfarë bëjnë njerëzit e vërtetë,” thotë Jonathan Starck, CTO i Synthesia. Që në foshnjëri, “ju jeni vërtet të lidhur me njerëzit dhe fytyrat. Ju e dini se çfarë është e drejtë, kështu që çdo gjë që nuk është plotësisht e drejtë, me të vërtetë kërcen një milje.”

Këto video të mëhershme të krijuara nga AI, si “deepfakes” më gjerësisht, janë bërë duke përdorur rrjete kundërshtare gjeneruese, ose GAN – një teknikë më e vjetër për gjenerimin e imazheve dhe videove që përdor dy rrjete nervore që luajnë njëra-tjetrën. Ishte një proces i mundimshëm dhe i ndërlikuar dhe teknologjia ishte e paqëndrueshme.

Por në bumin gjenerues të AI të vitit të kaluar apo më shumë, kompania ka zbuluar se mund të krijojë avatarë shumë më të mirë duke përdorur rrjete nervore gjeneruese që prodhojnë cilësi më të lartë në mënyrë më të qëndrueshme. Sa më shumë të dhëna të ushqehen këto modele, aq më mirë mësojnë. Synthesia përdor modele të mëdha gjuhësore dhe modele difuzioni për ta bërë këtë; të parët ndihmojnë avatarët të reagojnë ndaj skriptit, dhe të dytët gjenerojnë piksele.

Pavarësisht kërcimit në cilësi, kompania ende nuk po e drejton veten në industrinë e argëtimit. Synthesia vazhdon ta shohë veten si një platformë për bizneset. Basti i tij është ky: Ndërsa njerëzit kalojnë më shumë kohë duke parë video në YouTube dhe TikTok, do të ketë më shumë kërkesa për përmbajtje video. Të rinjtë tashmë po anashkalojnë kërkimin tradicional dhe po kalojnë në TikTok për informacionin e paraqitur në formë video. Riparbelli argumenton se teknologjia e Synthesia mund t’i ndihmojë kompanitë të konvertojnë komunikimet dhe raportet e tyre të mërzitshme të korporatës dhe materialet e trajnimit në përmbajtje që njerëzit do të shikojnë dhe angazhohen në të vërtetë. Ai sugjeron gjithashtu se mund të përdoret për të bërë materiale marketingu.

Ai pretendon se teknologjia e Synthesia përdoret nga 56% e Fortune 100, me shumicën dërrmuese të atyre kompanive që e përdorin atë për komunikim të brendshëm. Kompania liston Zoom, Xerox, Microsoft dhe Reuters si klientë. Shërbimet fillojnë nga 22 dollarë në muaj.

Kjo, shpreson kompania, do të jetë një alternativë më e lirë dhe më efikase ndaj videove nga një kompani profesionale produksioni—dhe një alternativë që mund të jetë pothuajse e padallueshme nga ajo. Riparbelli më thotë se avatarët e tij më të rinj mund të mashtrojnë lehtësisht një person duke menduar se janë të vërtetë.

“Unë mendoj se ne jemi 98% atje,” thotë ai.

Në hulumtimin e AI, ekziston një thënie: Plehrat brenda, mbeturinat jashtë. Nëse të dhënat që shkuan në trajnimin e një modeli AI janë mbeturina, kjo do të pasqyrohet në rezultatet e modelit. Sa më shumë pika të dhënash që modeli i AI të ketë kapur nga lëvizjet e fytyrës sime, mikroshprehjet, animet e kokës, pulsimet, ngritjet e supet dhe valët e duarve, aq më realist do të jetë avatari.

Kur kthehem në studio, po përpiqem shumë që të mos jem plehra.

Unë jam duke qëndruar përpara një ekrani të gjelbër dhe Oshinyemi më udhëzon në procesin fillestar të kalibrimit, ku më duhet të lëviz kokën dhe më pas sytë në një lëvizje rrethore. Me sa duket, kjo do t’i lejojë sistemit të kuptojë ngjyrat e mia natyrore dhe tiparet e fytyrës. Më pas më kërkohet të them fjalinë “Të gjithë djemtë hëngrën një peshk”, e cila do të kapë të gjitha lëvizjet e gojës të nevojshme për të formuar zanoret dhe bashkëtingëlloret. Ne gjithashtu filmojmë pamjet e mia duke “përtaci” në heshtje.

Më pas më kërkon të lexoj një skenar për një YouTuber fiktiv në tone të ndryshme, duke më drejtuar në spektrin e emocioneve që duhet të përcjell. Së pari duhet ta lexoj në një mënyrë neutrale, informuese, pastaj në një mënyrë inkurajuese, një mënyrë të mërzitur dhe ankimore dhe në fund një mënyrë të emocionuar, bindëse.

“Hej, të gjithë – mirë se erdhët në “Elevate Her” me nikoqirin tuaj, Jess Mars. Është mirë që të kemi këtu. Ne jemi gati të merremi me një temë që është mjaft delikate dhe sinqerisht godet afër shtëpisë—duke trajtuar kritikat në udhëtimin tonë shpirtëror,” lexova nga teleprompteri, njëkohësisht duke u përpjekur të përfytyroj përçarjet për diçka ndaj partnerit tim gjatë versionit ankimor. “Pavarësisht se ku shikoni, duket sikur ka gjithmonë një zë kritik të gatshëm për të dëgjuar, apo jo?”

“Ishte vërtet mirë. Po e shikoja dhe thashë: ‘Epo, kjo është e vërtetë. Ajo padyshim që ankohet’”, thotë Oshinyemi, inkurajues. Herën tjetër, mbase shtoni ndonjë gjykim, sugjeron ai.

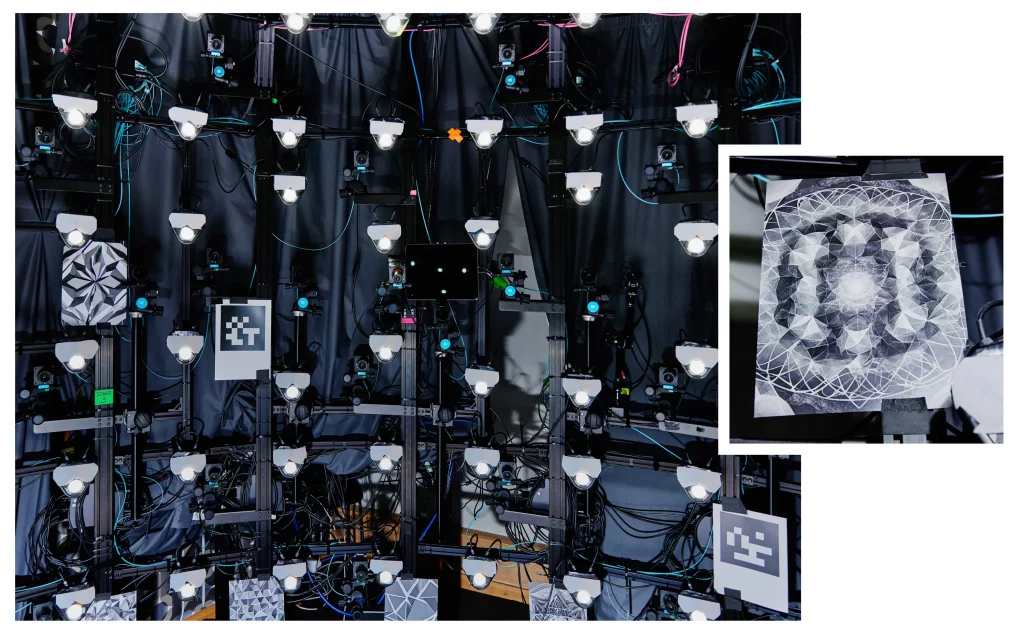

Ne filmojmë disa filma me variacione të ndryshme të skenarit. Në disa versione më lejohet të lëviz duart. Në të tjerat, Oshinyemi më kërkon të mbaj një kunj metalike midis gishtërinjve si unë. Kjo është për të testuar “skajet” e aftësive të teknologjisë kur bëhet fjalë për komunikimin me duar, thotë Oshinyemi.

Historikisht, bërja e avatarëve të AI të duken të natyrshme dhe përputhja e lëvizjeve të gojës me të folurin ka qenë një sfidë shumë e vështirë, thotë David Barber, një profesor i mësimit të makinerive në University College London, i cili nuk është i përfshirë në punën e Synthesia. Kjo për shkak se problemi shkon përtej lëvizjeve të gojës; ju duhet të mendoni për vetullat, të gjithë muskujt e fytyrës, ngritjen e shpatullave dhe lëvizjet e shumta të ndryshme të vogla që njerëzit përdorin për t’u shprehur.

Synthesia ka punuar me aktorë për të trajnuar modelet e saj që nga viti 2020, dhe dyshe e tyre përbëjnë 225 avatarët e aksioneve që janë në dispozicion për klientët për t’u animuar me skenarët e tyre. Por për të trajnuar gjeneratën e saj të fundit të avatarëve, Synthesia kishte nevojë për më shumë të dhëna; ka kaluar vitin e kaluar duke punuar me rreth 1000 aktorë profesionistë në Londër dhe Nju Jork. (Synthesia thotë se nuk i shet të dhënat që mbledh, megjithëse lëshon disa prej tyre për qëllime kërkimore akademike.)

Aktorët më parë paguheshin sa herë që përdorej avatari i tyre, por tani kompania u paguan atyre një tarifë paraprake për të trajnuar modelin e AI. Synthesia përdor avatarët e tyre për tre vjet, në të cilin moment aktorët pyeten nëse duan të rinovojnë kontratat e tyre. Nëse po, ata vijnë në studio për të bërë një avatar të ri. Nëse jo, kompania do të fshijë të dhënat e tyre. Klientët e ndërmarrjeve të Synthesia mund të gjenerojnë gjithashtu avatarët e tyre të personalizuar duke dërguar dikë në studio për të bërë shumë nga ato që po bëj.

Midis fotove, artisti i grimit hyn dhe bën disa prekje për t’u siguruar që të dukem njësoj në çdo foto. E ndjej veten duke u skuqur për shkak të dritave në studio, por edhe për shkak të aktrimit. Pasi ekipi ka mbledhur të gjitha fotot që i nevojiten për të kapur shprehjet e mia të fytyrës, zbres poshtë për të lexuar më shumë tekst me zë të lartë për mostrat e zërit.

Ky proces kërkon që unë të lexoj një pasazh që tregon se unë pranoj në mënyrë të qartë që zëri im të klonohet dhe se ai mund të përdoret në llogarinë e Voica në platformën Synthesia për të gjeneruar video dhe fjalim.

Ky proces është shumë i ndryshëm nga mënyra se si krijohen shumë avatarë të AI, falsifikime të thella ose media sintetike – sido që të doni t’i quani ato.

Shumica e “deepfakes” nuk krijohen në studio. Studimet kanë treguar se shumica dërrmuese e “deepfakes” në internet janë përmbajtje seksuale jokonsensuale, zakonisht duke përdorur imazhe të vjedhura nga mediat sociale. Inteligjenca artificiale gjeneruese e ka bërë krijimin e këtyre “deepfakes” të lehtë dhe të lirë, dhe ka pasur disa raste të profilit të lartë në SHBA dhe Evropë të fëmijëve dhe grave që janë abuzuar në këtë mënyrë. Ekspertët kanë ngritur gjithashtu alarmin se teknologjia mund të përdoret për përhapjen e dezinformatave politike, një kërcënim veçanërisht i mprehtë duke pasur parasysh numrin rekord të zgjedhjeve që po ndodhin në mbarë botën këtë vit.

Politika e Synthesia është të mos krijojë avatarë të njerëzve pa pëlqimin e tyre të qartë. Por ajo nuk ka qenë e imunizuar nga abuzimi. Vitin e kaluar, studiuesit gjetën dezinformata pro Kinës që u krijuan duke përdorur avatarët e Synthesia dhe të paketuara si lajme, të cilat kompania tha se shkelnin kushtet e saj të shërbimit.

Që atëherë, kompania ka vendosur sisteme më rigoroze të verifikimit dhe moderimit të përmbajtjes. Ai aplikon një filigran me informacione se ku dhe si janë krijuar videot e avatarit të AI. Aty ku dikur kishte katër moderatorë të brendshëm të përmbajtjes, njerëzit që e bëjnë këtë punë tani përbëjnë 10% të stafit prej 300 personash. Ajo punësoi gjithashtu një inxhinier për të ndërtuar sisteme më të mira të moderimit të përmbajtjes me fuqi AI. Këta filtra ndihmojnë Synthesia-n të kontrollojë çdo gjë të vetme që klientët e saj përpiqen të gjenerojnë. Çdo gjë e dyshimtë ose e paqartë, si p.sh. përmbajtja në lidhje me kriptovalutat ose shëndetin seksual, u përcillet moderatorëve të përmbajtjes njerëzore. Synthesia gjithashtu mban një regjistrim të të gjitha videove që krijon sistemi i saj.

Dhe ndërsa çdokush mund t’i bashkohet platformës, shumë veçori nuk janë të disponueshme derisa njerëzit të kalojnë përmes një sistemi të gjerë verifikimi të ngjashëm me atë të përdorur nga industria bankare, i cili përfshin bisedën me ekipin e shitjeve, nënshkrimin e kontratave ligjore dhe paraqitjen në auditimin e sigurisë, thotë Voica. Klientët e nivelit fillestar janë të kufizuar në prodhimin e përmbajtjes rreptësisht faktike dhe vetëm klientët e ndërmarrjeve që përdorin avatarë të personalizuar mund të gjenerojnë përmbajtje që përmban opinione. Për më tepër, vetëm organizatat e akredituara të lajmeve lejohen të krijojnë përmbajtje për çështjet aktuale.

“Ne nuk mund të pretendojmë se jemi perfekt. Nëse njerëzit na raportojnë gjëra, ne ndërmarrim veprime të shpejta, [siç është] ndalimi ose kufizimi i individëve ose organizatave,” thotë Voica. Por ai beson se këto masa funksionojnë si një pengesë, që do të thotë se shumica e aktorëve të këqij do të kthehen në mjetet me burim të hapur të disponueshëm lirisht.

I vë në provë disa nga këto kufij kur shkoj në zyrën e Synthesia për hapin tjetër në procesin e krijimit të avatarit tim. Për të krijuar videot që do të shfaqin avatarin tim, më duhet të shkruaj një skenar. Duke përdorur llogarinë e Voica, vendos të përdor pjesë nga Hamleti, si dhe artikuj të mëparshëm që kam shkruar. Unë përdor gjithashtu një veçori të re në platformën Synthesia, e cila është një asistent i AI që transformon çdo lidhje ose dokument ueb në një skript të gatshëm. Përpiqem ta bëj avatarin tim të lexojë lajmet për sanksionet e reja të Bashkimit Evropian kundër Iranit.

Voica më shkruan menjëherë: “Më fute në telashe!”

Ofrimi i shërbimeve pa këto kufizime do të ishte “një strategji e shkëlqyer rritjeje”, ankohet Riparbelli. Por “në fund të fundit, ne kemi rregulla shumë strikte se çfarë mund të krijoni dhe çfarë nuk mund të krijoni. Ne mendojmë se mënyra e duhur për të përhapur këto teknologji në shoqëri është të jemi paksa tepër kufizues në fillim.”

Megjithatë, edhe nëse këto parmakë do të funksiononin në mënyrë të përsosur, rezultati përfundimtar do të ishte megjithatë një internet ku gjithçka është e rreme. Dhe eksperimenti im më bën të pyes veten se si mund të përgatitemi.

Peizazhi ynë i informacionit tashmë ndihet shumë i errët. Nga njëra anë, është rritur ndërgjegjësimi i publikut se përmbajtja e krijuar nga AI po lulëzon dhe mund të jetë një mjet i fuqishëm për dezinformimin. Por nga ana tjetër, është ende e paqartë nëse falsifikimet e thella përdoren për keqinformim në shkallë dhe nëse ato po lëvizin gjerësisht gjilpërën për të ndryshuar besimet dhe sjelljet e njerëzve.

Nëse njerëzit bëhen shumë skeptikë për përmbajtjen që shohin, ata mund të ndalojnë së besuari në asgjë, gjë që mund t’u mundësojë aktorëve të këqij të përfitojnë nga ky vakum besimi dhe të gënjejnë për vërtetësinë e përmbajtjes reale. Studiuesit e kanë quajtur këtë ” dividend i gënjeshtarit “. Ata paralajmërojnë se politikanët, për shembull, mund të pretendojnë se informacioni i vërtetë inkriminues ishte i rremë ose i krijuar duke përdorur AI.

Claire Leibowicz, drejtuese e AI dhe integritetit të medias në Partneritetin jofitimprurës për AI, thotë se ajo shqetësohet se rritja e ndërgjegjësimit për këtë boshllëk do ta bëjë më të lehtë “mohimin dhe hedhjen e dyshimit mbi materialin ose median reale si provë në shumë kontekste të ndryshme”. jo vetëm në lajme, [por] edhe në gjykata, në industrinë e shërbimeve financiare dhe në shumë prej institucioneve tona.” Ajo më thotë se është e inkurajuar nga burimet që Synthesia i ka kushtuar moderimit dhe pëlqimit të përmbajtjes, por thotë se ky proces nuk është kurrë i përsosur.

Edhe Riparbelli pranon se në afat të shkurtër, përhapja e përmbajtjes së gjeneruar nga AI ndoshta do të shkaktojë telashe. Ndërsa njerëzit janë trajnuar të mos besojnë gjithçka që lexojnë, ata ende priren t’u besojnë imazheve dhe videove, shton ai. Ai thotë se njerëzit tani duhet të testojnë vetë produktet e AI për të parë se çfarë është e mundur dhe nuk duhet t’i besojnë asgjë që shohin në internet nëse nuk e kanë verifikuar atë.

Mos ki parasysh që rregullimi i AI është ende i paqartë dhe përpjekjet e sektorit të teknologjisë për të verifikuar origjinën e përmbajtjes janë ende në fazat e tyre të hershme. A munden konsumatorët, me shkallët e tyre të ndryshme të edukimit mediatik, të luftojnë me të vërtetë valën në rritje të përmbajtjeve të dëmshme të gjeneruara nga AI përmes veprimeve individuale?

Një ditë pas vizitës sime të fundit, Voica më dërgon me email videot me avatarin tim. Kur i pari fillon të luajë, unë jam i befasuar. Është po aq e dhimbshme sa të shohësh veten në kamerë ose të dëgjosh një regjistrim të zërit tënd. Pastaj e kap veten. Në fillim mendova se avatari isha unë.

Sa më shumë që shikoj video të “vetes time”, aq më shumë spiralizoj. Vërtet po këqyr kaq shumë? Të injoroj kaq shumë? Dhe të lëviz nofullën time kështu? Jezusin.

Eshte mire. Është vërtet mirë. Por nuk është perfekt. “Animacion çuditërisht i mirë,” më shkruan partneri im.

“Por zëri ndonjëherë tingëllon tamam si ju, dhe herë të tjera si një amerikan i përgjithshëm dhe me një ton të çuditshëm,” shton ai. “AF e çuditshme.”

Ai ka të drejtë. Zëri ndonjëherë jam unë, por në jetën reale unë umm dhe ahh më shumë. Ajo që është e jashtëzakonshme është se u zbulua një parregullsi në mënyrën se si unë flas. Theksi im është një rrëmujë transatlantike, e hutuar nga vitet e kaluara duke jetuar në MB, duke parë TV amerikan dhe duke ndjekur shkollën ndërkombëtare. Avatari im ndonjëherë thotë fjalën “robot” me theks britanik dhe herë të tjera me theks amerikan. Është diçka që ndoshta askush tjetër nuk do ta vinte re. Por AI bëri.

Gama e emocioneve të avatarit tim është gjithashtu e kufizuar. Ai jep fjalimin e Shekspirit “Të jesh apo të mos jesh” shumë çështje fakti. E kisha drejtuar të zemërohej kur lexoja një tregim që shkrova për depfakes nudo jokonsensuale të Taylor Swift-it ; avatari është i ankuar dhe i gjykueshëm, me siguri, por jo i zemëruar.

Kjo nuk është hera e parë që e bëj veten një subjekt testimi për AI të re. Jo shumë kohë më parë, u përpoqa të gjeneroja imazhe të avatarit të AI, vetëm për të marrë një mori nudosh . Ajo përvojë ishte një shembull i hidhur se sa të njëanshëm mund të jenë sistemet e AI. Por kjo përvojë – dhe kjo mënyrë e veçantë për t’u përjetësuar – ishte padyshim në një nivel tjetër.

Carl Öhman, një asistent profesor në Universitetin e Uppsalas, i cili ka studiuar mbetjet dixhitale dhe është autor i një libri të ri, The Afterlife of Data , i quan avatarë si ata që kam bërë “kufoma dixhitale”.

“Duket tamam si ju, por askush nuk është në shtëpi,” thotë ai. “Do të ishte e barabartë me klonimin tuaj, por kloni juaj ka vdekur. Dhe pastaj ju jeni duke e gjallëruar kufomën, në mënyrë që të lëvizë dhe të flasë, me impulse elektrike.

Kështu ndihet. Mënyrat e vogla dhe të nuancuara që nuk e njoh veten janë të mjaftueshme për të më shtyrë. Pastaj përsëri, avatari mund të mashtrojë këdo që nuk më njeh shumë mirë. Me të vërtetë shkëlqen kur prezantoj një histori që kam shkruar se si fusha e robotikës mund të marrë momentin e saj ChatGPT ; asistenti virtual i AI përmbledh leximin e gjatë në një video të shkurtër të mirë, të cilën avatari im e rrëfen. Nuk është Shekspiri, por është më i mirë se shumë prej prezantimeve të korporatave që më është dashur të ulem. Mendoj se nëse do ta përdorja këtë për t’iu dorëzuar kolegëve të mi një raport të fundvitit, ndoshta ai nivel autenticiteti do të mjaftonte.

Dhe kjo është shitja, sipas Riparbelli: “Ajo që po bëjmë është më shumë si PowerPoint sesa si Hollywood”.

Gjenerata më e re e avatarëve sigurisht që nuk janë gati për ekranin e argjendtë. Ata janë ende të mbërthyer në modalitetin e portretit, duke treguar vetëm avatarin përpara dhe nga beli lart. Por në një të ardhme jo shumë të largët, thotë Riparbelli, kompania shpreson të krijojë avatarë që mund të komunikojnë me duart e tyre dhe të bisedojnë me njëri-tjetrin. Ai po planifikon gjithashtu avatarë me trup të plotë që mund të ecin dhe të lëvizin në një hapësirë që një person ka krijuar. (Punimi për të mundësuar këtë teknologji tashmë ekziston; në fakt është vendi ku jam unë në imazhin në krye të kësaj pjese.)

Por a e duam vërtet këtë? Ndjehet si një e ardhme e zymtë ku njerëzit po konsumojnë përmbajtje të krijuar nga AI që u është paraqitur atyre nga avatarët e gjeneruar nga AI dhe duke përdorur AI për ta ripaketuar atë në më shumë përmbajtje, e cila ka të ngjarë të gërvishtet për të gjeneruar më shumë AI. Nëse asgjë tjetër, ky eksperiment më bëri të qartë se sektori i teknologjisë duhet urgjentisht të përforcojë praktikat e tij të moderimit të përmbajtjes dhe të sigurojë që teknikat e origjinës së përmbajtjes, si p.sh. filigrani, të jenë të qëndrueshme.

Edhe nëse teknologjia dhe moderimi i përmbajtjes së Synthesia nuk janë ende perfekte, ato janë dukshëm më të mira se çdo gjë që kam parë në këtë fushë më parë, dhe kjo është vetëm pas një viti apo më shumë nga bumi aktual në AI gjeneruese. Zhvillimi i inteligjencës artificiale ecën me shpejtësi marramendëse, dhe është emocionuese dhe e frikshme të mendosh se si do të duken avatarët e AI në vetëm disa vite. Ndoshta në të ardhmen do të na duhet të adoptojmë fjalë të sigurta për të treguar se në fakt po komunikoni me një njeri të vërtetë, jo me një AI.

Por ajo ditë nuk është sot.

Më dukej çuditërisht ngushëlluese fakti që në një nga videot, avatari im bërtet për falsifikime të thella jokonsensuale dhe thotë, me një zë të lumtur sociopatik: “Gjiganët e teknologjisë? Oh! Ata po bëjnë një vrasje!”

Unë kurrë nuk do.