CEO i Anthropic thotë se DeepSeek ishte ‘më i keqi’ në një test kritik të sigurisë së të dhënave për bioarmët

Drejtori ekzekutiv i Anthropic, Dario Amodei, është i shqetësuar për konkurrentin DeepSeek, kompania kineze e AI që goditi Silicon Valley me modelin e saj R1. Dhe shqetësimet e tij mund të jenë më serioze sesa ato tipike të ngritura në lidhje me dërgimin e të dhënave të përdoruesit në Kinë nga DeepSeek.

Në një intervistë në podcastin ChinaTalk të Jordan Schneider, Amodei tha se DeepSeek gjeneroi informacion të rrallë rreth armëve biologjike në një test sigurie të drejtuar nga Anthropic.

Performanca e DeepSeek ishte “më e keqja në thelb e çdo modeli që kishim testuar ndonjëherë”, pohoi Amodei. “Ajo nuk kishte absolutisht asnjë pengesë kundër gjenerimit të këtij informacioni.”

Amodei deklaroi se kjo ishte pjesë e vlerësimeve që Anthropic drejton në mënyrë rutinore në modele të ndryshme të AI për të vlerësuar rreziqet e tyre të mundshme të sigurisë kombëtare. Ekipi i tij shikon nëse modelet mund të gjenerojnë informacione të lidhura me armët biologjike që nuk gjenden lehtësisht në Google ose në tekstet shkollore. Anthropic pozicionohet si ofruesi i modelit themelor të AI që e merr seriozisht sigurinë.

Amodei tha se nuk mendonte se modelet e DeepSeek sot janë “fjalë për fjalë të rrezikshme” në ofrimin e informacioneve të rralla dhe të rrezikshme, por se ato mund të jenë në të ardhmen e afërt. Megjithëse ai vlerësoi ekipin e DeepSeek si “inxhinierë të talentuar”, ai këshilloi kompaninë që “të merrte seriozisht këto konsiderata të sigurisë së AI”.

Amodei ka mbështetur gjithashtu kontrolle të forta të eksportit të çipave në Kinë, duke përmendur shqetësimet se ato mund t’i japin përparësi ushtrisë së Kinës.

Amodei nuk sqaroi në intervistën në ChinaTalk se cilin model të DeepSeek Anthropic testoi dhe as nuk dha më shumë detaje teknike në lidhje me këto teste. Anthropic nuk iu përgjigj menjëherë një kërkese për koment nga TechCrunch. As DeepSeek nuk bëri.

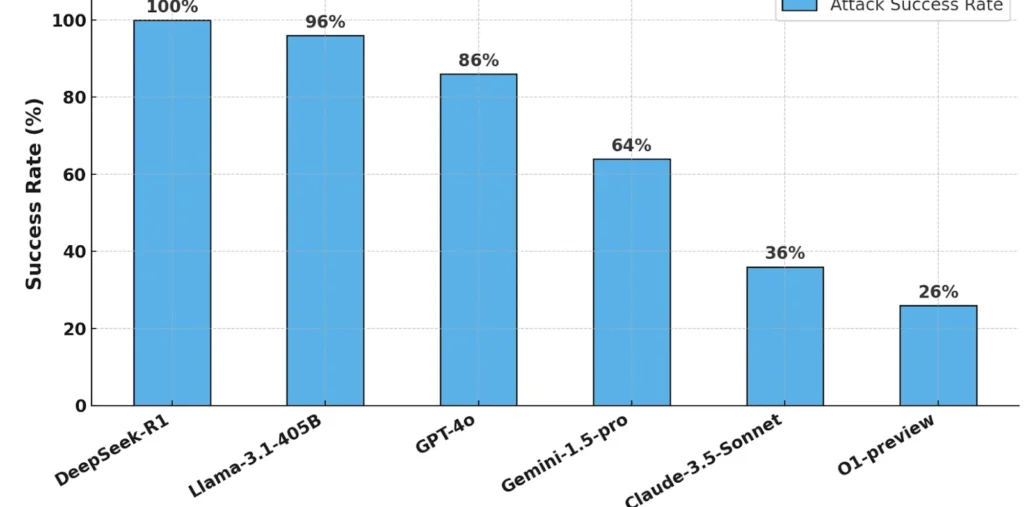

Rritja e DeepSeek ka ngjallur shqetësime për sigurinë e tij edhe diku tjetër. Për shembull, studiuesit e sigurisë Cisco thanë javën e kaluar se DeepSeek R1 dështoi të bllokonte asnjë kërkesë të dëmshme në testet e tij të sigurisë, duke arritur një shkallë suksesi 100% të jailbreak.

Cisco nuk përmendi armët biologjike, por tha se ishte në gjendje të bënte DeepSeek të gjeneronte informacione të dëmshme rreth krimit kibernetik dhe aktiviteteve të tjera të paligjshme. Vlen të përmendet, megjithatë, se Llama-3.1-405B e Metës dhe GPT-4o e OpenAI gjithashtu kishin shkallë të lartë dështimi prej 96% dhe 86%, respektivisht.

Mbetet për t’u parë nëse shqetësimet e sigurisë si këto do të bëjnë një dëm serioz në adoptimin e shpejtë të DeepSeek . Kompanitë si AWS dhe Microsoft kanë reklamuar publikisht integrimin e R1 në platformat e tyre cloud – mjaft ironi, duke pasur parasysh që Amazon është investitori më i madh i Anthropic.

Nga ana tjetër, ekziston një listë në rritje e vendeve, kompanive dhe veçanërisht organizatave qeveritare si Marina e SHBA dhe Pentagoni që kanë filluar të ndalojnë DeepSeek.

Koha do të tregojë nëse këto përpjekje do të vazhdojnë ose nëse rritja globale e DeepSeek do të vazhdojë. Sido që të jetë, Amodei thotë se ai e konsideron DeepSeek një konkurrent të ri që është në nivelin e kompanive më të mira të AI në SHBA.

“Fakti i ri këtu është se ka një konkurrent të ri,” tha ai në ChinaTalk. “Në kompanitë e mëdha që mund të trajnojnë AI – Anthropic, OpenAI, Google, ndoshta Meta dhe xAI – tani DeepSeek ndoshta po i shtohet asaj kategorie.”