DeepSeek publikon një përditësim të madh për DeepSeek V3

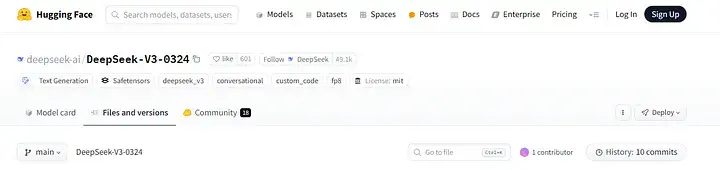

Në një lëvizje befasuese, DeepSeek lëshoi së fundmi DeepSeek-V3–0324, një përmirësim i rëndësishëm për modelin e tij DeepSeek V3, i disponueshëm në Hugging Face. Ky publikim shënon një hap përtej përditësimit të vogël të parashikuar nga shumë njerëz, duke ofruar një model më të fuqishëm dhe efikas të AI për zhvilluesit dhe bizneset.

Përditësimi bazohet në reputacionin e DeepSeek si një lider në AI me burim të hapur, veçanërisht me arkitekturën e tij Mixture-of-Experts (MoE), i cili aktivizon vetëm 37 miliardë parametra nga 671 miliardë masive për çdo shenjë. Ky dizajn optimizon performancën duke i mbajtur kostot të ulëta, një shenjë dalluese e qasjes inovative të DeepSeek.

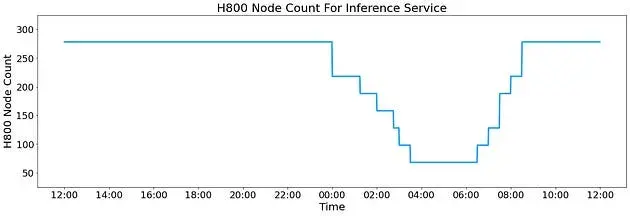

DeepSeek-V3–0324 prezanton Vëmendjen Latent me shumë kokë (MLA) dhe një arkitekturë të përmirësuar DeepSeekMoE, të vërtetuar më parë në DeepSeek-V2. Këto përmirësime mundësojnë përfundime më të shpejta dhe trajnime më efikase, duke kërkuar vetëm 2,788 milionë orë GPU H800 për para-trajnim të plotë në 14,8 trilion tokena me cilësi të lartë.

Modeli është pionier i një strategjie ndihmëse pa humbje për balancimin e ngarkesës, duke siguruar shpërndarje të barabartë të detyrave llogaritëse në kuadrin e tij të MM. Për më tepër, ai zbaton një objektiv trajnimi parashikimi me shumë shenja, duke rritur performancën e tij në detyra komplekse si kodimi dhe arsyetimi.

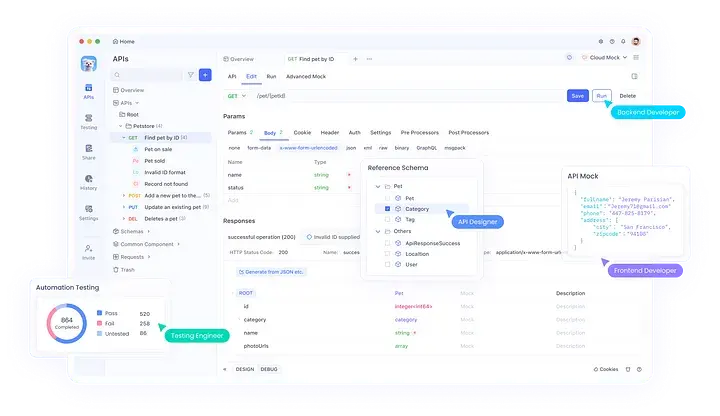

Zhvilluesit tani mund të hyjnë në DeepSeek-V3–0324 nëpërmjet DeepSeek API, i cili ruan përputhshmërinë me formatin API të OpenAI. Kjo lejon integrimin pa probleme në rrjedhat ekzistuese të punës duke përdorur mjete si OpenAI SDK, duke e bërë më të lehtë shfrytëzimin e aftësive të DeepSeek për aplikacionet e botës reale.

Publikimi i DeepSeek-V3–0324 vjen në një moment kyç në industrinë e AI, pas diskutimeve globale mbi aksesin dhe koston e AI. Në vitin 2024, njoftimi i qeverisë amerikane për Projektin Stargate prej 500 miliardë dollarësh theksoi pengesat financiare për zhvillimin e modeleve të mëdha gjuhësore (LLM). Inovacioni me kosto të ulët i DeepSeek që pretendon të zhvillojë modele si DeepSeek R1 për nën 6 milionë dollarë sfidon këtë tregim dhe e pozicionon kompaninë si një përçarës.

Performanca e DeepSeek-V3–0324 rivalizon modelet më të mira me burim të mbyllur, ndërsa mbetet me burim të hapur dhe falas, siç vërehet në depon e tij Hugging Face. Kjo demokratizon aksesin për zhvilluesit, veçanërisht në kodimin dhe zhvillimin e frontendit, ku modeli shkëlqen. Aftësia e tij për të gjeneruar një faqe moderne të uljes me një kërkesë të vetme, siç tregohet në aplikacionet e fundit, tregon dobinë e saj praktike.

DeepSeek API luan një rol kritik në shfrytëzimin e aftësive të DeepSeek-V3–0324. Duke përdorur pikën fundore të API-së (p.sh., https://api.deepseek.com/v1 ), zhvilluesit mund të ndërveprojnë me modelin duke përdorur kërkesat standarde HTTP, duke specifikuar modele si “deepseek-chat” ose DeepSeek-V3 i përmirësuar.

Për të përdorur API-në, zhvilluesit marrin një çelës API dhe dërgojnë kërkesa në formatin JSON, siç tregohet në dokumentacionin e DeepSeek (api-docs.deepseek.com). Për shembull, një komandë curl mund të kërkojë modelin për përgjigje, duke e bërë atë ideal për ndërtimin e aplikacioneve në kodim, chatbot ose detyra arsyetimi.

Kjo përputhshmëri me strukturën API të OpenAI thjeshton miratimin, duke i lejuar zhvilluesit të testojnë DeepSeek-V3–0324 në mjedise të konfiguruara tashmë për modelet OpenAI. Për një përvojë të përmirësuar të zhvillimit, merrni parasysh shkarkimin falas të Apidog-it, një mjet të fuqishëm të zhvillimit të API-së që thjeshton testimin dhe integrimin e modeleve si DeepSeek-V3–0324 në projektet tuaja.

Trajnimi i DeepSeek-V3–0324 në 14,8 trilion argumente të ndryshëm, i ndjekur nga fazat e Rregullimit të Përsosur të Mbikëqyrur (SFT) dhe të Mësimit të Përforcimit (RL), përmirëson aftësitë e tij të arsyetimit dhe kodimit. Aftësia e modelit për të distiluar arsyetimin e zinxhirit të gjatë të mendimit (CoT) nga DeepSeek R1 në LLM standarde si DeepSeek-V3 përmirëson më tej performancën e tij në detyra komplekse.

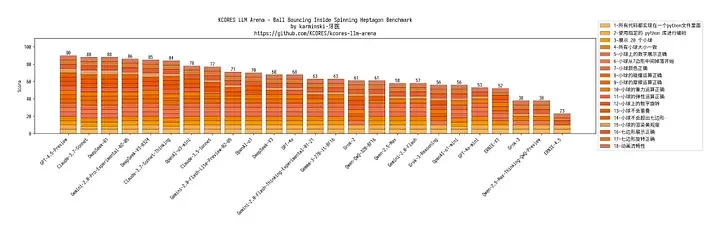

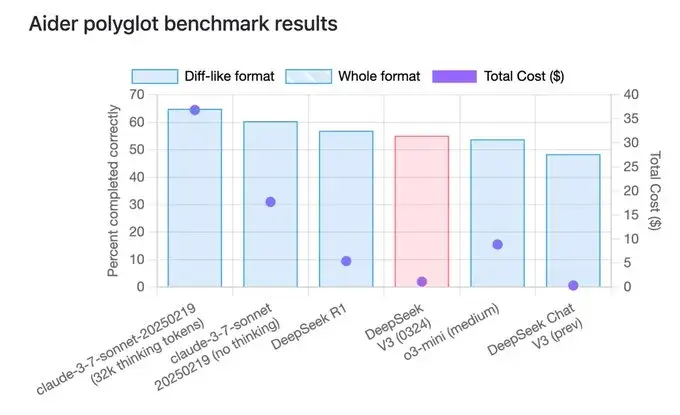

Veçanërisht, V3 i ri i DeepSeek shënoi 55% në standardin poliglot të Aider, duke u përmirësuar ndjeshëm në krahasim me versionin e mëparshëm. Kjo e pozicionon DeepSeek-V3–0324 si modelin numër 2 që nuk mendon/arsyeton, pas vetëm Sonnet 3.7, ndërsa mbetet konkurrues me modelet e të menduarit si DeepSeek R1 dhe o3-mini i OpenAI.

Me 685 miliardë parametra të ruajtur në formatin Safetensors në Hugging Face, DeepSeek-V3–0324 ofron shkallëzim për aplikacionet e nivelit të ndërmarrjes duke ruajtur efikasitetin. Lloji i tij tensor FP8 redukton përdorimin e kujtesës, duke e bërë atë të aksesueshëm në konfigurimet standarde të harduerit.

Standardet tregojnë se DeepSeek-V3–0324 ka tejkaluar rivalët me burim të hapur dhe përputhet me liderët me burim të mbyllur si Claude 3.7 Sonnet në disa detyra, të gjitha duke mbetur me kosto efektive dhe të pakufizuar për përdoruesit.

Për zhvilluesit, natyra me burim të hapur të DeepSeek-V3–0324 dhe aksesueshmëria në API e ulin pengesën e hyrjes për ndërtimin e aplikacioneve të avancuara të drejtuara nga AI. Forca e tij në zhvillimin e front-endit, siç shihet në gjenerimin e faqeve të uljes me një kërkesë të vetme, e bën atë një zgjedhje të përshtatshme për zhvilluesit e uebit dhe projektuesit UI/UX.

Bizneset mund të përdorin DeepSeek-V3–0324 për të transformuar operacionet përmes zgjidhjeve të tij të pajtueshme me SaaS, duke reduktuar mbështetjen në modelet e shtrenjta të pronarit. DeepSeek API mundëson integrimin e pandërprerë në sistemet ekzistuese, duke mbështetur vendosje të shkallëzueshme dhe me kosto efektive të AI.

Ky përmirësim përputhet me misionin e DeepSeek për të avancuar dhe demokratizuar AI, siç përshkruhet në depon e tij Hugging Face dhe dokumentacionin GitHub, duke përforcuar rolin e tij si një lojtar kyç në ekosistemin global të AI.

Publikimi i DeepSeek-V3–0324 sinjalizon një epokë të re të zhvillimit të AI me burim të hapur, duke sfiduar dominimin e modeleve me kosto të lartë dhe me burim të mbyllur. Ndërsa DeepSeek vazhdon të inovojë, e dëshmuar nga përparimi i tij i shpejtë nga DeepSeek Coder në 2023 në DeepSeek-V3 në 2025, ai vendos një pikë referimi për efikasitetin dhe aksesin.

Integrimi i modelit në DeepSeek API dhe disponueshmëria e tij në platforma si Hugging Face inkurajojnë kontributet e komunitetit, duke nxitur një mjedis bashkëpunues për avancimin e AI. Zhvilluesit mund të eksplorojnë më tej aftësitë e tij duke eksperimentuar me API dhe duke shkarkuar mjete si Apidog falas për të optimizuar rrjedhat e tyre të punës.