Google lançon modelet e reja Gemini 2.0 Pro dhe Flash-Lite AI

Google njoftoi sot se Gemini 2.0 Flash tani është përgjithësisht i disponueshëm, së bashku me lançimin Gemini 2.0 Pro Experimental dhe Gemini 2.0 Flash-Lite, një model me kosto efektive të AI, i krijuar për detyra me efikasitet të lartë.

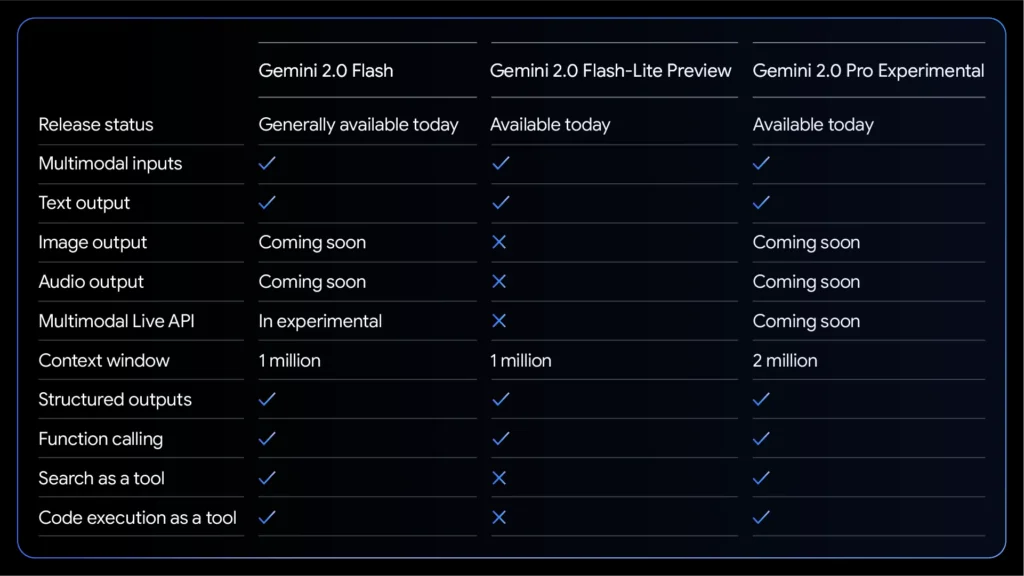

Gemini 2.0 Flash tani është përgjithësisht i disponueshëm nëpërmjet Google AI Studio dhe Vertex AI.

Gemini 2.0 Pro Experimental, modeli më i aftë i Google deri më tani, është tani i aksesueshëm për zhvilluesit dhe përdoruesit e Gemini Advanced.

Flash-Lite, një model i ri me kosto të ulët, ofron performancë të përmirësuar në krahasim me Gemini 1.5 Flash me të njëjtin çmim.

Këto publikime janë pjesë e shtytjes më të gjerë të Google për të avancuar aftësitë e agjentëve të AI.

Gemini 2.0 Pro, modeli kryesor në këtë version, vjen me një dritare konteksti prej 2 milionësh – kapacitet të mjaftueshëm për të përpunuar afërsisht 1.5 milionë fjalë menjëherë. Kjo dritare e gjerë e kontekstit lejon modelin të trajtojë sasi dukshëm më të mëdha informacioni sesa paraardhësit e tij.

Sipas Logan Kilpatrick, Menaxher i Lartë i Produkteve për Gemini API dhe Google AI Studio, varianti Pro shkëlqen veçanërisht në detyrat e kodimit dhe menaxhimin e kërkesave komplekse. Ai gjithashtu integrohet me Google Search dhe mbështet përdorimin e mjeteve të jashtme, duke përforcuar fokusin e Google në agjentët e drejtuar nga AI që automatizojnë detyrat me shumë hapa.

Kompania gjithashtu po e bën Gemini 2.0 Flash gjerësisht të disponueshëm pasi fillimisht e lançoi atë për përdoruesit e aplikacionit Gemini javën e kaluar. Ky model është i optimizuar për detyra me volum të lartë dhe me frekuencë të lartë, duke e bërë atë një kalë pune ideale për bizneset që integrojnë AI në shkallë.

Ndërkohë, Gemini 2.0 Flash-Lite prezanton një opsion më të përballueshëm të AI pa sakrifikuar performancën. Ai ruan përmirësimet e performancës së serisë 2.0 ndërsa përputhet me çmimin e paraardhësit të tij 1.5. Për zhvilluesit që punojnë me aplikacione me volum të lartë, Flash-Lite ofron një opsion ekonomik me 0,75 cent për milion argumente për hyrjet e tekstit, imazhit dhe videove – një ulje e konsiderueshme e kostos në krahasim me modelin standard Flash 10 cent për milion argumente.

Për të përfunduar publikimet e sotme, Google ka vënë Gemini 2.0 Flash Thinking modelin eksperimental të disponueshëm për të gjithë përdoruesit e aplikacionit Gemini. Në një seri postimesh në X, CEO Sundar Pichai theksoi aftësinë e modelit për t’u integruar me ekosistemin e shërbimeve të Google, duke përfshirë YouTube, Search dhe Maps, duke mundësuar më shumë ndërveprime kontekstuale dhe të informuara.

Peizazhi konkurrues po ndryshon me shpejtësi. Lëvizja e Google pason presionin në rritje nga rivalët si DeepSeek, modelet e të cilëve kanë fituar tërheqje për aftësitë e tyre të arsyetimit me kosto më të ulëta. OpenAI, Microsoft dhe Meta po përshpejtojnë gjithashtu përpjekjet e tyre për të zhvilluar agjentë të AI të aftë për të trajtuar detyrat e sofistikuara të përdoruesit pa udhëzime hap pas hapi.

Me këto publikime të reja, Google po e pozicionon Gemini si një platformë thelbësore të AI për zhvilluesit, duke theksuar fleksibilitetin, përballueshmërinë dhe performancën më të avancuar. Me modele me kosto efikase si Flash-Lite dhe opsione me performancë të lartë si Pro, Google po rafinon ofertat e tij të AI për të përmbushur kërkesat e konsumatorëve dhe të ndërmarrjeve, duke vendosur skenën për një treg edhe më konkurrues të AI në 2025.

Nëse jeni një biznes ose zhvillues që kërkon të zbatojë këto modele të reja, ato janë të disponueshme përmes platformave Google AI Studio dhe Vertex AI.