Modeli i ri i AI ‘Titans’ i Google i jep modeleve gjuhësore memorie afatgjatë

Studiuesit e Google kanë zhvilluar një lloj të ri modeli Transformer që u jep modeleve gjuhësore diçka të ngjashme me kujtesën afatgjatë. Sistemi mund të trajtojë sekuenca shumë më të gjata informacioni sesa modelet aktuale, duke çuar në performancë më të mirë në detyra të ndryshme.

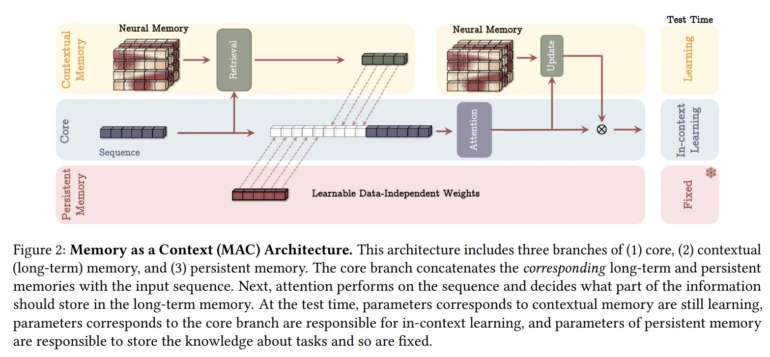

Arkitektura e re “Titans” merr frymëzim nga mënyra se si funksionon kujtesa njerëzore. Duke kombinuar kujtesën artificiale të shkurtër dhe afatgjatë përmes blloqeve të vëmendjes dhe MLP-ve të kujtesës, sistemi mund të punojë me sekuenca të gjata informacioni.

Një nga veçoritë e zgjuara të sistemit është se si vendos se çfarë të mbajë mend. Titans përdor “surprizën” si metrikën e tij kryesore – sa më e papritur të jetë një pjesë e informacionit, aq më shumë ka gjasa që të ruhet në kujtesën afatgjatë. Sistemi gjithashtu e di se kur duhet t’i harrojë gjërat, duke e ndihmuar atë të përdorë hapësirën e kujtesës në mënyrë efikase.

Ekipi krijoi tre versione të ndryshme të Titans, ku secili trajton ndryshe memorien afatgjatë:

- Memoria si kontekst (MAC)

- Memoria si portë (MAG)

- Memoria si shtresë (MAL)

Ndërsa secili version ka pikat e tij të forta, varianti MAC funksionon veçanërisht mirë me sekuenca shumë të gjata.

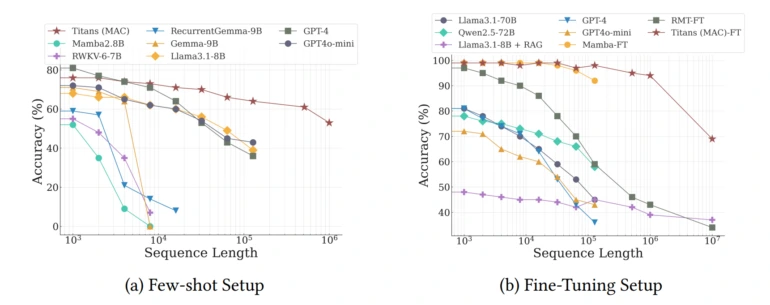

Në testime të gjera, Titans ia kalonin modelet tradicionale si Transformer klasik dhe modelet më të reja hibride si Mamba2, veçanërisht kur kemi të bëjmë me tekste shumë të gjata. Ekipi thotë se mund të trajtojë dritaret e kontekstit prej më shumë se 2 milion argumentesh në mënyrë më efektive, duke vendosur rekorde të reja si për modelimin e gjuhës ashtu edhe për parashikimin e serive kohore me kontekste të gjata.

Sistemi shkëlqeu edhe në testin “Gjilpëra në kashtë”, ku duhet të gjejë informacione specifike në tekste shumë të gjata. Titans arritën mbi 95% saktësi edhe me tekste me 16,000 shenja. Ndërsa disa modele nga OpenAI, Anthropic dhe Google performojnë më mirë, ato janë shumë më të mëdha – versioni më i madh i Titans ka vetëm 760 milionë parametra.

Titans tregoi vërtet forcën e tij në standardin BABILong, një test sfidues i të kuptuarit afatgjatë ku modelet duhet të lidhin fakte të përhapura nëpër dokumente shumë të gjata. Sistemi i tejkaloi modelet më të mëdha si GPT-4, RecurrentGemma-9B dhe Llama3.1-70B. Ai madje mundi Llama3 me Gjenerimin e Shtuar të Rikthimit (RAG), megjithëse disa modele të specializuara rikthimi ende performojnë më mirë.

Ekipi pret që kodin ta bëjë publikisht në të ardhmen e afërt. Ndërsa Titans dhe arkitekturat e ngjashme mund të çojnë në modele gjuhësore që trajtojnë kontekste më të gjata dhe nxjerrin përfundime më të mira, përfitimet mund të shtrihen përtej vetëm përpunimit të tekstit. Testet e hershme të ekipit me modelimin e ADN-së sugjerojnë se teknologjia mund të përmirësojë edhe aplikacione të tjera, duke përfshirë modelet video – duke supozuar se rezultatet premtuese të standardeve qëndrojnë në përdorim në botën reale.