OpenAI i bën thirrje Trump-it të eliminojë kufizimet për industrinë e AI

OpenAI i ka dorëzuar një propozim të gjatë qeverisë amerikane, duke synuar të ndikojë në Planin e saj të Veprimit të AI-së, një raport strategjie që shumë besojnë se do të udhëheqë politikën e Presidentit Donald Trump për teknologjinë e inteligjencës artificiale.

Propozimi nga kompania më e njohur amerikane e inteligjencës artificiale është e parashikueshme e diskutueshme, duke i bërë thirrje qeverisë amerikane të theksojë shpejtësinë e zhvillimit mbi kontrollin rregullator, duke paralajmëruar gjithashtu për rreziqet që vijnë nga firmat kineze të AI për vendin.

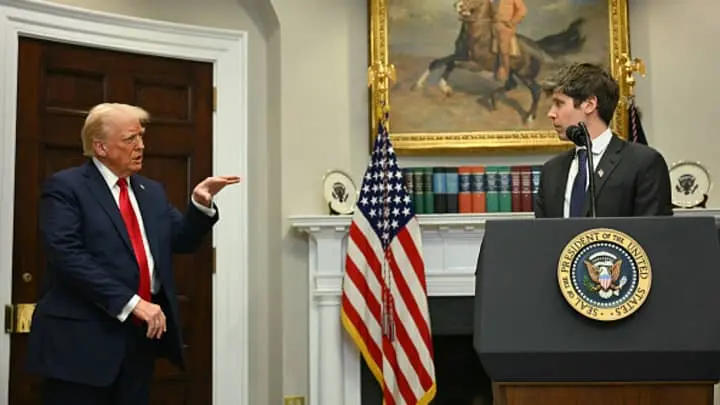

Trump bëri thirrje që Plani i Veprimit i AI të hartohej nga Zyra e Politikave të Shkencës dhe Teknologjisë dhe t’i dorëzohej atij brenda korrikut, menjëherë pasi kishte marrë rezidencën e tij të dytë në Shtëpinë e Bardhë. Kjo ndodhi në janar, kur ai hodhi poshtë një urdhër ekzekutiv në lidhje me AI që u nënshkrua nga paraardhësi i tij Joe Biden në tetor 2023, duke e zëvendësuar atë me të tijin , duke deklaruar se “është politika e Shteteve të Bashkuara për të mbështetur dhe përmirësuar dominimin global të AI të Amerikës”.

OpenAI ka humbur pak kohë në përpjekjen për të ndikuar në rekomandimet në atë plan, dhe në propozimin e tij ka bërë të qartë ndjenjat e tij për nivelin aktual të rregullimit në industrinë e AI. Ai bëri thirrje që zhvilluesve të inteligjencës artificiale t’u jepet “liria për të inovuar në interesin kombëtar” dhe mbrojti një “partneritet vullnetar midis qeverisë federale dhe sektorit privat”, në vend të “ligjeve shtetërore tepër të rënda”.

Ai argumenton se qeveria federale duhet të lejohet të punojë me kompanitë e AI mbi një “bazë thjesht vullnetare dhe opsionale”, duke thënë se kjo do të ndihmojë në promovimin e inovacionit dhe adoptimit të teknologjisë. Për më tepër, ai bëri thirrje që SHBA të krijojë një “strategji të kontrollit të eksportit” që mbulon sistemet e inteligjencës artificiale të prodhuara në SHBA, e cila do të promovojë adoptimin global të teknologjisë së saj të AI.

Kompania argumenton më tej në rekomandimet e saj që qeveria t’u japë agjencive federale liri më të madhe për të “testuar dhe eksperimentuar” teknologjitë e AI duke përdorur “të dhëna reale”, dhe gjithashtu kërkoi që Trump të japë një heqje të përkohshme që do të mohonte nevojën që ofruesit e AI të certifikohen sipas Programit Federal të Menaxhimit të Riskut dhe Autorizimit. Ai i bëri thirrje Trumpit të “modernizojë” procesin nëpër të cilin duhet të kalojnë kompanitë e AI për t’u miratuar për përdorim nga qeveria federale, duke kërkuar krijimin e një “rruge më të shpejtë, të bazuar në kritere për miratimin e mjeteve të AI”.

OpenAI argumenton se rekomandimet e tij do të bëjnë të mundur që sistemet e reja të AI të përdoren nga agjencitë e qeverisë federale deri në 12 muaj më shpejt se sa është e mundur aktualisht. Megjithatë, disa ekspertë të industrisë kanë ngritur shqetësime se miratimi i tillë i shpejtë i AI nga qeveria mund të krijojë probleme sigurie dhe privatësie.

Duke u shtyrë më fort, OpenAI i tha gjithashtu qeverisë amerikane se duhet të bashkëpunojë më ngushtë me kompanitë e sektorit privat në mënyrë që të ndërtojë sisteme të AI për përdorim të sigurisë kombëtare. Ai shpjegoi se qeveria mund të përfitonte nga të paturit e modeleve të saj të AI që janë të trajnuar në grupe të dhënash të klasifikuara, pasi këto mund të “rregullohen mirë për të qenë të jashtëzakonshëm në detyrat e sigurisë kombëtare”.

OpenAI ka një interes të madh në hapjen e sektorit të qeverisë federale për produktet dhe shërbimet e AI, pasi ka lançuar një version të specializuar të ChatGPT, të quajtur ChatGPT Gov, në janar. Është krijuar për t’u drejtuar nga agjencitë qeveritare në mjediset e tyre të sigurta kompjuterike, ku ata kanë më shumë kontroll mbi sigurinë dhe privatësinë.

Përveç promovimit të përdorimit të inteligjencës artificiale nga qeveria, OpenAI dëshiron gjithashtu që qeveria amerikane ta bëjë jetën e saj më të lehtë duke zbatuar një “strategji të së drejtës së autorit që promovon lirinë për të mësuar”. Ai kërkoi që Trump të zhvillojë rregullore që do të ruajnë aftësinë e modeleve amerikane të AI për të mësuar nga materialet me të drejtë autori.

“Amerika ka kaq shumë startup të AI, tërheq kaq shumë investime dhe ka bërë kaq shumë përparime kërkimore kryesisht sepse doktrina e përdorimit të drejtë promovon zhvillimin e AI,” tha kompania.

Është një kërkesë e diskutueshme, sepse kompania aktualisht po lufton me shumë organizata lajmesh, muzikantë dhe autorë mbi pretendimet për shkelje të të drejtave të autorit. ChatGPT origjinale që u lançua në fund të vitit 2022 dhe modelet më të fuqishme që janë lëshuar që atëherë janë të gjitha të trajnuara kryesisht në internetin publik, i cili është burimi kryesor i njohurive të tyre.

Megjithatë, kritikët e kompanisë thonë se në thelb është thjesht plagjiaturë e përmbajtjes nga faqet e internetit të lajmeve, shumë prej të cilave janë të paguara. OpenAI është goditur me padi nga The New York Times, Chicago Tribune, New York Daily News dhe Qendra për Raportim Investigativ, redaksia më e vjetër jofitimprurëse e vendit. Artistë dhe autorë të shumtë kanë marrë gjithashtu masa ligjore ndaj kompanisë.

Rekomandimet e OpenAI synonin edhe disa nga rivalët e kompanisë, veçanërisht DeepSeek Ltd., laboratori kinez i AI që pretendon se ka zhvilluar modelin DeepSeek R-1 me një pjesë të vogël të kostos së çdo gjëje që OpenAI ka zhvilluar.

Kompania e përshkroi DeepSeek si “të subvencionuar nga shteti” dhe “të kontrolluar nga shteti” dhe i kërkoi qeverisë të konsideronte ndalimin e modeleve të saj dhe atyre nga firmat e tjera kineze të AI.

Në propozim, OpenAI pretendoi se modeli R1 i DeepSeek është “i pasigurt”, sepse kërkohet nga ligji kinez që të pajtohet me disa kërkesa në lidhje me të dhënat e përdoruesit. Duke ndaluar përdorimin e modeleve nga Kina dhe vendet e tjera “Tier 1”, SHBA do të jetë në gjendje të minimizojë “rrezikun e vjedhjes së IP” dhe rreziqe të tjera, tha ai.

“Ndërsa Amerika mban një epërsi në AI sot, DeepSeek tregon se epërsia jonë nuk është e gjerë dhe po ngushtohet,” tha OpenAI.