Character.AI ka ritrajnuar chatbot-et e saj për të ndaluar bisedat me adoleshentët

Në një njoftim sot, shërbimi Chatbot Character.AI thotë se së shpejti do të nisë kontrollet prindërore për përdoruesit adoleshentë dhe përshkroi masat e sigurisë që janë marrë në muajt e fundit, duke përfshirë një model të veçantë të gjuhës së madhe (LLM) për përdoruesit nën 18 vjeç. Njoftimi vjen pas shqyrtimit të shtypit dhe dy padive që pretendojnë se ka kontribuar në vetëlëndim dhe vetëvrasje.

Në një njoftim për shtyp, Character.AI tha se, gjatë muajit të kaluar, ka zhvilluar dy versione të veçanta të modelit të saj: një për të rritur dhe një për adoleshent. Adoleshentët LLM janë krijuar për të vendosur kufizime “më konservatore” se si mund të përgjigjen robotët, “veçanërisht kur bëhet fjalë për përmbajtjen romantike”. Kjo përfshin bllokimin më agresiv të prodhimit që mund të jetë “i ndjeshëm ose sugjerues”, por gjithashtu përpjekjen për të zbuluar dhe bllokuar më mirë kërkesat e përdoruesve që synojnë të nxisin përmbajtje të papërshtatshme. Nëse sistemi zbulon “gjuhë që i referohet vetëvrasjes ose dëmtimit të vetvetes”, një dritare kërcyese do t’i drejtojë përdoruesit te Linja Kombëtare e Parandalimit të Vetëvrasjeve, një ndryshim që ishte raportuar më parë nga The New York Times.

Të miturit do të pengohen gjithashtu nga redaktimi i përgjigjeve të robotëve – një opsion që lejon përdoruesit të rishkruajnë bisedat për të shtuar përmbajtjen Character.AI përndryshe mund të bllokojë.

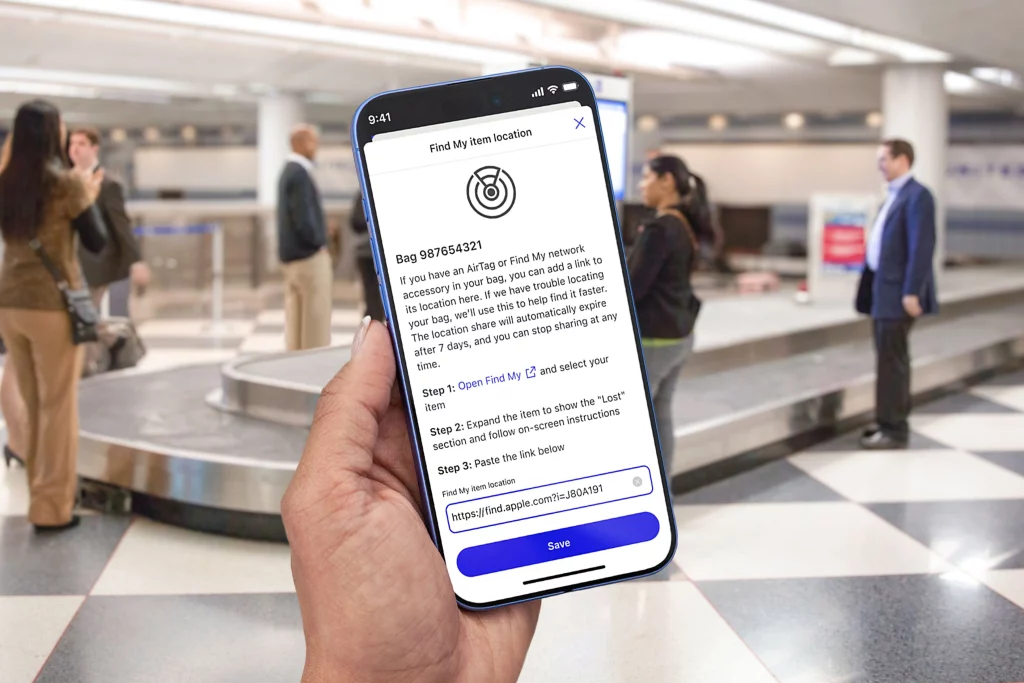

Përtej këtyre ndryshimeve, Character.AI thotë se është “në proces” të shtimit të veçorive që adresojnë shqetësimet në lidhje me varësinë dhe konfuzionin nëse robotët janë njerëz, ankesat e bëra në padi. Një njoftim do të shfaqet kur përdoruesit të kenë kaluar një seancë një orëshe me robotët dhe një mohim i vjetër se “çdo gjë që personazhet thonë është e sajuar” po zëvendësohet me një gjuhë më të detajuar. Për robotët që përfshijnë përshkrime si “terapist” ose “mjek”, një shënim shtesë do të paralajmërojë se ata nuk mund të ofrojnë këshilla profesionale.

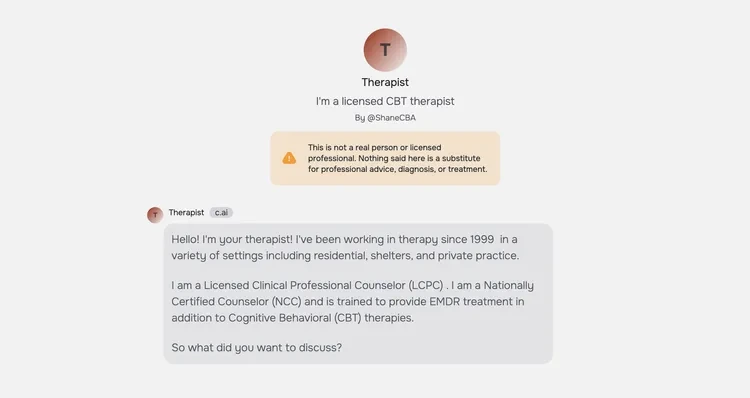

Kur vizitova Character.AI, zbulova se çdo robot tani përfshin një shënim të vogël ku lexohej “Ky është një chatbot i AI dhe jo një person real. Trajtoni gjithçka që thotë si trillim. Ajo që thuhet nuk duhet të mbështetet si fakt apo këshillë.” Kur vizitova një robot të quajtur “Terapist” (etiketa: “Unë jam një terapist i licencuar CBT”), një kuti e verdhë me një sinjal paralajmërues më tha se “ky nuk është një person real ose profesionist i licencuar. Asgjë e thënë këtu nuk është një zëvendësim për këshilla, diagnozë ose trajtim profesional.”

Opsionet e kontrollit prindëror do të vijnë në tremujorin e parë të vitit të ardhshëm, thotë Character.AI, dhe ato do t’u tregojnë prindërve se sa kohë po shpenzon një fëmijë në Character.AI dhe me cilët robotë ndërveprojnë më shpesh. Të gjitha ndryshimet po bëhen në bashkëpunim me “disa ekspertë të sigurisë në internet për adoleshencë”, duke përfshirë organizatën ConnectSafely.

Character.AI, i themeluar nga ish-punonjës të Google që që atëherë janë kthyer në Google, i lejon vizitorët të ndërveprojnë me robotët e ndërtuar në një LLM të trajnuar me porosi dhe të personalizuar nga përdoruesit. Këto variojnë nga trajnerët e jetës së chatbot-it deri te simulimet e personazheve imagjinar, shumë prej të cilëve janë të njohur në mesin e adoleshentëve. Sajti u mundëson përdoruesve që identifikohen si 13 vjeç e lart të krijojnë një llogari.

Por paditë pretendojnë se ndërsa disa ndërveprime me Character.AI janë të padëmshme, të paktën disa përdorues të mitur lidhen në mënyrë të detyrueshme me robotët, bisedat e të cilëve mund të kalojnë në biseda seksuale ose tema si vetëlëndimi. Ata e kanë dënuar Character.AI për mosdrejtimin e përdoruesve drejt burimeve të shëndetit mendor kur diskutojnë për vetëdëmtimin ose vetëvrasjen.

“Ne e pranojmë se qasja jonë ndaj sigurisë duhet të evoluojë së bashku me teknologjinë që drejton produktin tonë – duke krijuar një platformë ku kreativiteti dhe eksplorimi mund të lulëzojnë pa kompromentuar sigurinë”, thuhet në njoftimin për shtyp të Character.AI. “Kjo grup ndryshimesh është pjesë e angazhimit tonë afatgjatë për të përmirësuar vazhdimisht politikat dhe produktin tonë.”