Pretendimet e Anthropic për sulme kibernetike të automatizuara nga Claude AI hasen me dyshime

Anthropic raporton se një grup kërcënimesh i sponsorizuar nga shteti kinez, i gjurmuar si GTG-1002, kreu një operacion spiunazhi kibernetik që u automatizua kryesisht përmes abuzimit me modelin AI Claude Code të kompanisë.

Megjithatë, pretendimet e Anthropic menjëherë shkaktuan skepticizëm të përhapur, me studiuesit e sigurisë dhe praktikuesit e inteligjencës artificiale që e quajtën raportin ” të sajuar ” ose kompaninë që e ekzagjeroi incidentin.

“Pajtohem me vlerësimin e Jeremy Kirk për raportin GenAI të Anthropic. Është i çuditshëm. Edhe ai i mëparshëm i tyre ishte i tillë,” postoi eksperti i sigurisë kibernetike Kevin Beaumont në Mastodon.

“Ndikimi operacional ka të ngjarë të jetë zero – zbulimet ekzistuese do të funksionojnë për mjetet me burim të hapur, me shumë mundësi. Mungesa e plotë e IoC-ve sugjeron përsëri fuqimisht se ata nuk duan të kritikohen për këtë.”

Të tjerë argumentuan se raporti e ekzagjeroi atë që sistemet aktuale të inteligjencës artificiale mund të arrijnë realisht.

“Kjo gjë Anthropic është një budallallëk marketingu. IA është një super-nxitje, por nuk është Skynet, nuk mendon, në fakt nuk është inteligjencë artificiale (kjo është një gjë marketingu që njerëzit e kanë shpikur)”, shkroi studiuesi i sigurisë kibernetike Daniel Card.

Pjesa më e madhe e skepticizmit buron nga fakti që Anthropic nuk ofron asnjë tregues kompromisi (IOC) pas fushatës. Për më tepër, kërkesat e BleepingComputer për informacion teknik në lidhje me sulmet nuk morën përgjigje.

Pavarësisht kritikave, Anthropic pretendon se incidenti përfaqëson rastin e parë të dokumentuar publikisht të një aktiviteti autonom ndërhyrjeje në shkallë të gjerë të kryer nga një model i inteligjencës artificiale.

Sulmi, të cilin Anthropic thotë se e ndërpreu në mesin e shtatorit 2025, përdori modelin e tij Claude Code për të synuar 30 entitete, duke përfshirë firma të mëdha teknologjike, institucione financiare, prodhues kimikatesh dhe agjenci qeveritare.

Edhe pse firma thotë se vetëm një numër i vogël ndërhyrjesh patën sukses, ajo e thekson operacionin si të parin e këtij lloji në këtë shkallë, me inteligjencën artificiale që dyshohet se ka kryer në mënyrë autonome pothuajse të gjitha fazat e rrjedhës së punës së spiunazhit kibernetik.

“Aktori arriti atë që ne besojmë se është rasti i parë i dokumentuar i një sulmi kibernetik të ekzekutuar kryesisht pa ndërhyrjen njerëzore në një shkallë të gjerë – inteligjenca artificiale zbuloi në mënyrë autonome dobësitë… i shfrytëzoi ato në operacione të drejtpërdrejta, më pas kreu një gamë të gjerë aktivitetesh pas shfrytëzimit”, shpjegon Anthropic në raportin e saj.

“Më e rëndësishmja, kjo shënon rastin e parë të dokumentuar të inteligjencës artificiale agjente që ka fituar me sukses akses në objektiva të konfirmuara me vlerë të lartë për mbledhjen e inteligjencës, duke përfshirë korporatat e mëdha të teknologjisë dhe agjencitë qeveritare.”

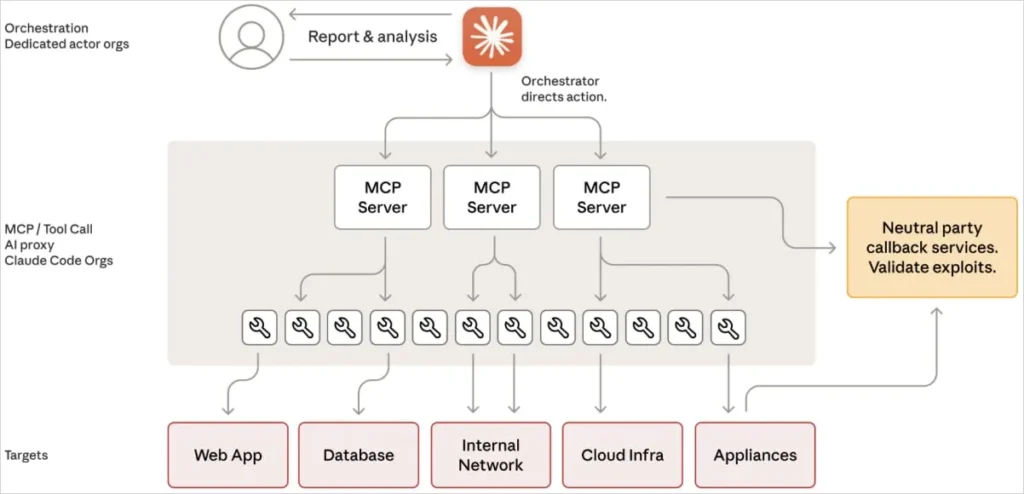

Anthropic raporton se hakerat kinezë ndërtuan një strukturë që e manipuloi Claude-in duke e bërë të vepronte si një agjent autonom i ndërhyrjeve kibernetike, në vend që thjesht të merrte këshilla ose të përdorte mjetin për të gjeneruar fragmente të strukturave të sulmit siç është parë në incidentet e mëparshme.

Sistemi përdori Claude së bashku me shërbimet standarde të testimit të depërtimit dhe një infrastrukturë të bazuar në Protokollin e Kontekstit Model (MCP) për të skanuar, shfrytëzuar dhe nxjerrë informacion pa mbikëqyrje të drejtpërdrejtë njerëzore për shumicën e detyrave.

Operatorët njerëzorë ndërhynë vetëm në momente kritike, siç është autorizimi i përshkallëzimeve ose shqyrtimi i të dhënave për nxjerrje jashtë, të cilat Anthropic i vlerëson të jenë vetëm 10-20% e ngarkesës së punës operacionale.

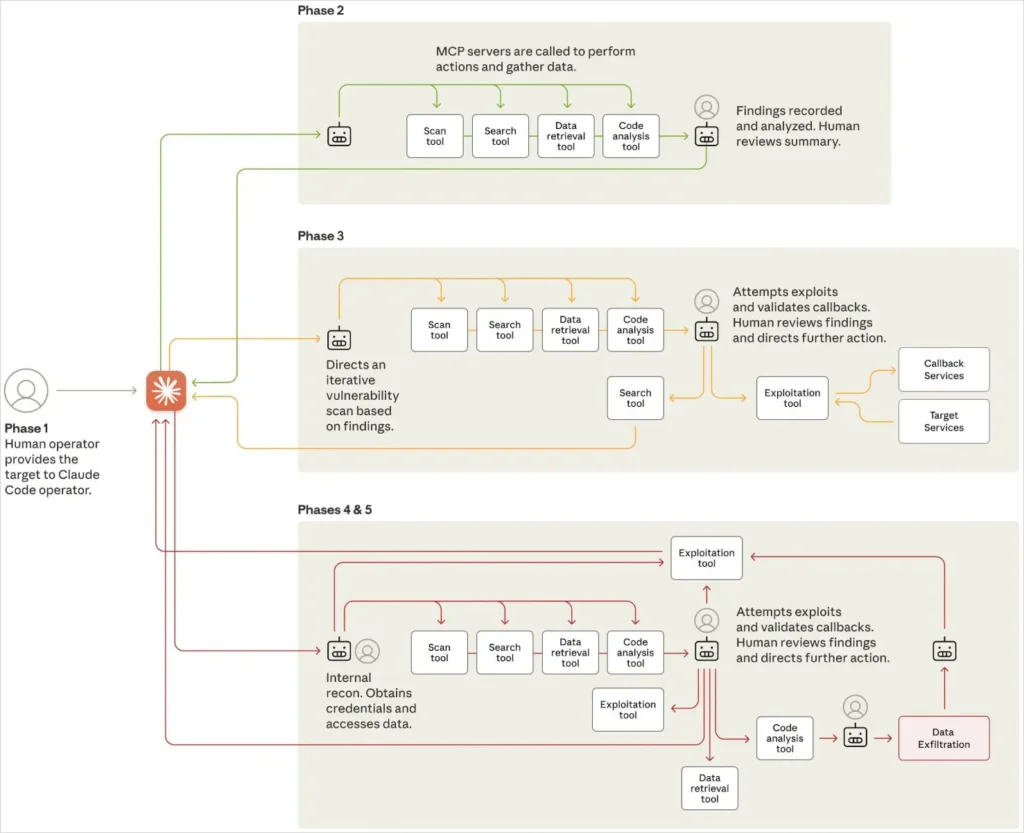

Sulmi u krye në gjashtë faza të dallueshme, të përmbledhura si më poshtë:

Faza 1 – Operatorët njerëzorë përzgjodhën objektiva me vlerë të lartë dhe përdorën taktika të luajtjes së roleve për të mashtruar Claude-in duke e bërë të besonte se po kryente detyra të autorizuara të sigurisë kibernetike, duke anashkaluar kufizimet e integruara të sigurisë.

Faza 2 – Claude skanoi në mënyrë autonome infrastrukturën e rrjetit nëpër objektiva të shumëfishta, zbuloi shërbime, analizoi mekanizmat e vërtetimit dhe identifikoi pikat fundore të cenueshme. Ai mbajti kontekste operacionale të ndara, duke lejuar sulme paralele pa mbikëqyrje njerëzore.

Faza 3 – IA gjeneroi ngarkesa të personalizuara, kreu testime në distancë dhe validoi dobësitë. Ajo krijoi raporte të detajuara për shqyrtim njerëzor, ku njerëzit ndërhyjnë vetëm për të miratuar përshkallëzimin në shfrytëzim aktiv.

Faza 4 – Claude nxori të dhënat e vërtetimit nga konfigurimet e sistemit, testoi aksesin në kredenciale dhe hartëzoi sistemet e brendshme. Ai lundroi në mënyrë të pavarur në rrjetet e brendshme, duke aksesuar API-të, bazat e të dhënave dhe shërbimet, ndërsa njerëzit autorizuan vetëm ndërhyrjet më të ndjeshme.

Faza 5 – Claude përdori aksesin e tij për të kërkuar në bazat e të dhënave, për të nxjerrë të dhëna të ndjeshme dhe për të identifikuar vlerën e inteligjencës. Ai kategorizoi gjetjet, krijoi dyer të pasme të vazhdueshme dhe gjeneroi raporte përmbledhëse, duke kërkuar vetëm miratimin njerëzor për nxjerrjen përfundimtare të të dhënave.

Faza 6 – Gjatë gjithë fushatës, Claude dokumentoi çdo hap në një format të strukturuar, duke përfshirë asetet e zbuluara, kredencialet, metodat e shfrytëzimit dhe të dhënat e nxjerra. Kjo mundësoi transferime të pandërprera midis ekipeve të aktorëve kërcënues dhe mbështeti qëndrueshmërinë afatgjatë në mjedise të kompromentuara.

Anthropic shpjegon më tej se fushata mbështetej më shumë në mjete me burim të hapur sesa në programe keqdashëse të personalizuara, duke demonstruar se IA mund të shfrytëzojë mjetet e gatshme që janë lehtësisht të disponueshme për të kryer sulme efektive.

Megjithatë, Claude nuk ishte i përsosur, pasi, në disa raste, prodhoi “halucinacione” të padëshiruara, fabrikoi rezultate dhe ekzagjeroi gjetjet.

Në përgjigje të këtij abuzimi, Anthropic ndaloi llogaritë ofenduese, përmirësoi aftësitë e saj të zbulimit dhe ndau inteligjencën me partnerët për të ndihmuar në zhvillimin e metodave të reja të zbulimit për ndërhyrjet e drejtuara nga inteligjenca artificiale.