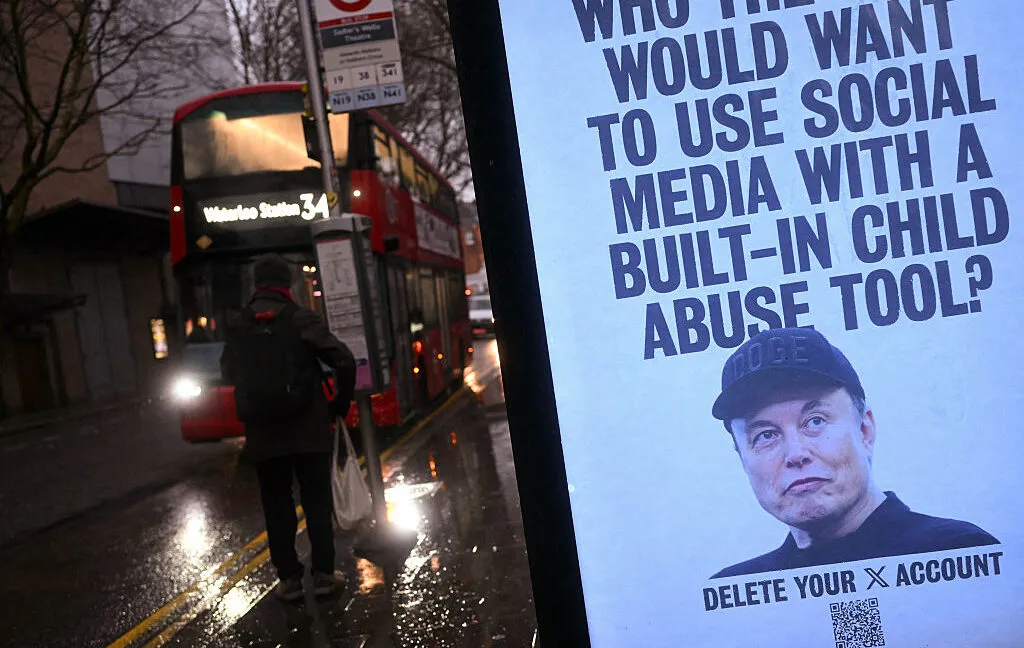

Elon Musk dhe xAI paditen për shndërrimin e fotove reale të tre vajzave në përmbajtje abuzive me AI (CSAM)

Një informacion nga një përdorues anonim i Discord i çoi policët të gjenin atë që mund të jenë materialet e para të konfirmuara të abuzimit seksual me fëmijë (CSAM) të gjeneruara nga Grok, të cilat xAI i Elon Musk nuk mund t’i shpërfillë lehtësisht si joekzistente.

Kohët e fundit në janar, Musk mohoi se Grok gjeneroi ndonjë CSAM gjatë një skandali në të cilin xAI refuzoi të përditësonte filtrat për të bllokuar chatbot-in nga nudifikimi i imazheve të njerëzve të vërtetë.

Në kulmin e polemikave, studiuesit nga Qendra për Kundërshtimin e Urrejtjes Dixhitale vlerësuan se Grok gjeneroi afërsisht tre milionë imazhe të seksualizuara, nga të cilat rreth 23,000 imazhe përshkruanin në dukje fëmijë. Në vend që të rregullonte Grok-un, xAI kufizoi aksesin në sistem vetëm për abonentët që paguanin. Kjo i pengoi rezultatet më tronditëse të qarkullonin në X, por më e keqja nuk u postua atje, raportoi Wired.

Në vend të kësaj, u gjenerua në Grok Imagine. Duke hulumtuar aplikacionin e pavarur, një studiues në janar zbuloi se pak më pak se 10 përqind e rreth 800 rezultateve të Imagine të shqyrtuara dukeshin se përfshinin CSAM. Në një postim X pas këtij zbulimi, Musk vazhdoi të hidhte poshtë provat dhe këmbënguli se ai “nuk ishte në dijeni të asnjë imazhi të zhveshur të të miturve të gjeneruar nga Grok”, duke theksuar se ai kishte parë “fjalë për fjalë zero”.

Megjithatë, Musk tani mund të detyrohet të përballet më në fund me problemin CSAM të Grok pasi një përdorues i Discord kontaktoi një viktimë, duke bërë që forcat e ligjit të përfshiheshin.

Në një padi kolektive të propozuar të ngritur të hënën, tre vajza të reja nga Tenesi dhe kujdestarët e tyre akuzuan Musk se e kishte projektuar qëllimisht Grok për të “përfituar nga grabitja seksuale e njerëzve të vërtetë, përfshirë fëmijët”. Ato vlerësuan se “të paktën mijëra të mitur” u viktimizuan dhe i kanë kërkuar një gjykate të distriktit amerikan një urdhër gjyqësor për t’i dhënë fund më në fund rezultateve të dëmshme të Grok. Ato gjithashtu kërkojnë dëmshpërblime, duke përfshirë dëmshpërblime ndëshkuese, për të gjithë të miturit e dëmtuar.

Një avokate që përfaqësonte vajzat, Annika K. Martin, konfirmoi në një njoftim për shtyp se jeta e tyre ishte “shkatërruar nga humbja shkatërruese e privatësisë dhe ndjenja e thellë e shkeljes që asnjë fëmijë nuk duhet ta përjetojë kurrë”.

“Këta janë fëmijë, fotografitë e të cilëve në shkollë dhe ato familjare u shndërruan në materiale abuzimi seksual me fëmijë nga një mjet inteligjence artificial i një kompanie miliarda dollarëshe dhe më pas u shkëmbyen midis grabitqarëve. Elon Musk dhe xAI e projektuan qëllimisht Grok për të prodhuar përmbajtje seksuale eksplicite për përfitime financiare, pa marrë parasysh fëmijët dhe të rriturit që do të dëmtoheshin prej saj”, tha Martin.

Dëmi është aq i madh sa, për vajzat që kërkojnë drejtësi, nuk mjafton që Musk të pranojë vetëm imazhet që ato mund të tregojnë Grokun të shtrembëruar në CSAM, tha Martin.

“Ne synojmë ta mbajmë xAI përgjegjëse për çdo fëmijë që ata dëmtuan në këtë mënyrë”, tha Martin.

Për njërën nga vajzat e reja, makthi filloi në dhjetor, thuhej në padi. Atëherë ajo mori një mesazh anonim në Instagram nga një përdorues i Discord duke e paralajmëruar se “fotot” e saj eksplicite ishin ndarë në një dosje së bashku me shumë të mitura të tjera. Përfundimisht, përdoruesi ndau “një seri imazhesh dhe videosh të gjeneruara nga inteligjenca artificiale, të cilat e përshkruanin atë” si dhe 18 vajza të tjera të mitura, dhe më pas e lidhi atë me një server Discord që ishte krijuar nga autori i krimit.

Tani mbi 18 vjeç, viktima e parë që mori informacionin ishte “e shqetësuar”, thuhej në padi, duke e pasur të vështirë të dallonte fotot e seksualizuara nga përmbajtja e saj reale. Ajo menjëherë e dinte se në cilat foto bazoheshin imazhet, shumica e të cilave ishin postuar në mediat e saj sociale kur ishte ende e mitur. Dhe shqetësuese është se ajo njohu disa nga vajzat e tjera në dosje nga shkolla e saj.

Instinkti i saj i parë ishte të kontaktonte viktimat e tjera që njihte, pastaj “në fund, u kontaktuan forcat lokale të rendit dhe u hap një hetim penal”, thuhej në padi.

Duke hetuar provat e Discord, policët përcaktuan shpejt se autori i krimit kishte qasje në Instagramin e viktimës së parë “sepse ai kishte mbajtur një marrëdhënie të ngushtë dhe miqësore” me të. Duke kontrolluar telefonin e tij, policët gjetën një aplikacion të palës së tretë që licenconte ose blinte qasje në Grok, të cilin ata arritën në përfundimin se autori e përdorte për të modifikuar fotot e vajzave.

Nga aty, aktori i keq ngarkoi imazhet në një platformë për ndarjen e skedarëve të quajtur Mega dhe i përdori ato si një “mjet shkëmbimi në bisedat në grup në Telegram me qindra përdorues të tjerë”, duke shkëmbyer skedarët AI CSAM “me përmbajtje seksuale eksplicite të të miturve të tjerë”.

Dëmet ndaj viktimave kanë qenë të shumta, thuhet në padi, duke përmendur shqetësime të forta emocionale dhe mendore. Për viktimat që e njohin autorin e krimit, ato mbeten të pasigurta nëse CSAM-i i gjeneruar nga Grok është ndarë me shokët e klasës apo është shpërndarë te të tjerët në shkollën e tyre, theksohet në padi. Një vajzë ka frikë se skandali do të ndikojë në pranimet e saj në kolegj, ndërsa një tjetër ndihet shumë e frikësuar për të marrë pjesë në diplomimin e saj.

Megjithatë, edhe më alarmuese se çdo i njohur që has në AI CSAM është frika se vajzat tani do të përndiqen për shkak të rezultateve të Grok. Siç shpjegon padia, “duket gjithashtu se emrat e vërtetë të viktimave dhe emri i shkollës së tyre ishin bashkangjitur në dosjet e tyre në internet, që do të thotë se grabitqarë të tjerë në internet mund të jenë gjithashtu në gjendje t’i identifikojnë ato, duke krijuar një rrezik të konsiderueshëm për përndjekje”.

Ndërsa më parë ishte raportuar se abonentët që paguanin të Grok Imagine po gjeneronin më shumë rezultate grafike sesa rezultatet e Grok që shkaktuan zemërim ndaj X, padia pretendon se xAI ka ndërmarrë edhe hapa të tjerë për të fshehur se si përfiton nga përmbajtja eksplicite që dëmton njerëz të vërtetë.

Padia pretendon se xAI gjithashtu shet licenca dhe akses në modelin e saj Grok AI te aplikacione të palëve të treta, si ai që përdori autori i krimit. Ky rregullim supozohet se i jep xAI një burim shtesë fitimi, ndërsa e izolon xAI nga dukshmëria se palët e treta po “përdorin serverat dhe platformat e xAI për të prodhuar përmbajtje CSAM të kërkuar nga klientët e këtyre aplikacioneve”, tha një njoftim për shtyp nga ekipi i tyre ligjor.

Me sa duket, e gjithë përmbajtja me përmbajtje seksuale eksplicite e gjeneruar nga palë të treta mbahet në serverat e xAI, dhe më pas shpërndahet nga xAI.

“xAI nuk e ka bërë modelin e inteligjencës artificiale të Grok të disponueshëm publikisht dhe nuk e ka licencuar Grok në tërësinë e tij, por në vend të kësaj licencon përdorimin e serverëve të tij për këto kompani ndërmjetëse, duke ditur se çdo përmbajtje e paligjshme dhe e paligjshme e gjeneruar përmes kërkesave për këto aplikacione në fund të fundit do të krijohet dhe shpërndahet nga serverët e xAI”, thuhej në padi.

Viktimat pretendojnë se konflikti e vë xAI në shkelje të qartë të ligjeve të pornografisë së fëmijëve:

Sipas informacionit dhe besimit, xAI zotëronte CSAM-in e Paditësve në serverat e saj pasi Grok prodhoi CSAM-in e tyre dhe më pas transportoi dhe shpërndau kontrabandën e paligjshme te klienti/përdoruesi i saj, përkatësisht, autori i krimit, duke përdorur aplikacionin e prerjes ose ndërmjetësimin e palës së tretë.

Ata shpresojnë që gjykata më në fund do ta bëjë të qartë nëse xAI e dinte që Grok po gjeneronte CSAM dhe nëse xAI me vetëdije e përpunonte atë përmbajtje në serverat e saj, pastaj vendosi ta shpërndante atë për të rritur të ardhurat e xAI. Nuk mund të ketë asnjë justifikim të vlefshëm për dështimin në mbrojtjen e të miturve nëse gjykata bie dakord me viktimat se xAI shkeli ligjet për pornografinë me fëmijë ose kishte një detyrim kujdesi, pretendohet në padi.

“Graviteti i dëmit të shkaktuar nga praktikat e të Paditurve tejkalon shumë çdo përfitim të supozuar të ‘modalitetit pikant’ të të Paditurve ose karakteristikave të tjera të përmbajtjes së pacensuruar”, thuhej në padi. “Asnjë interes legjitim biznesi nuk shërbehet duke hartuar një mjet të gjenerimit të imazheve me inteligjencë artificiale për të prodhuar CSAM.”

xAI nuk iu përgjigj menjëherë kërkesës së Ars për të komentuar. Por kompania më parë ka fajësuar përdoruesit që gjeneruan CSAM për reagimin negativ, ndërsa ka kërcënuar të pezullojë përdoruesit që abuzojnë me Grok.