‘Kontakti i Besuar’ i ChatGPT do të njoftojë të afërmit për shqetësime të sigurisë

OpenAI po lançon një veçori opsionale sigurie për ChatGPT që u lejon përdoruesve të rritur të caktojnë një kontakt emergjence për shqetësime të shëndetit mendor dhe sigurisë. Miqtë, anëtarët e familjes ose kujdestarët e caktuar si “Kontakt i Besuar” do të njoftohen nëse OpenAI zbulon se një person mund të ketë diskutuar tema si vetëlëndimi ose vetëvrasja me chatbot-in.

“Trusted Contact është projektuar rreth një parimi të thjeshtë dhe të validuar nga ekspertët: kur dikush mund të jetë në krizë, lidhja me dikë që e njeh dhe i beson mund të bëjë një ndryshim domethënës”, tha OpenAI në njoftimin e saj. “Ofron një shtresë tjetër mbështetjeje krahas linjave të ndihmës lokale që janë tashmë të disponueshme në ChatGPT.”

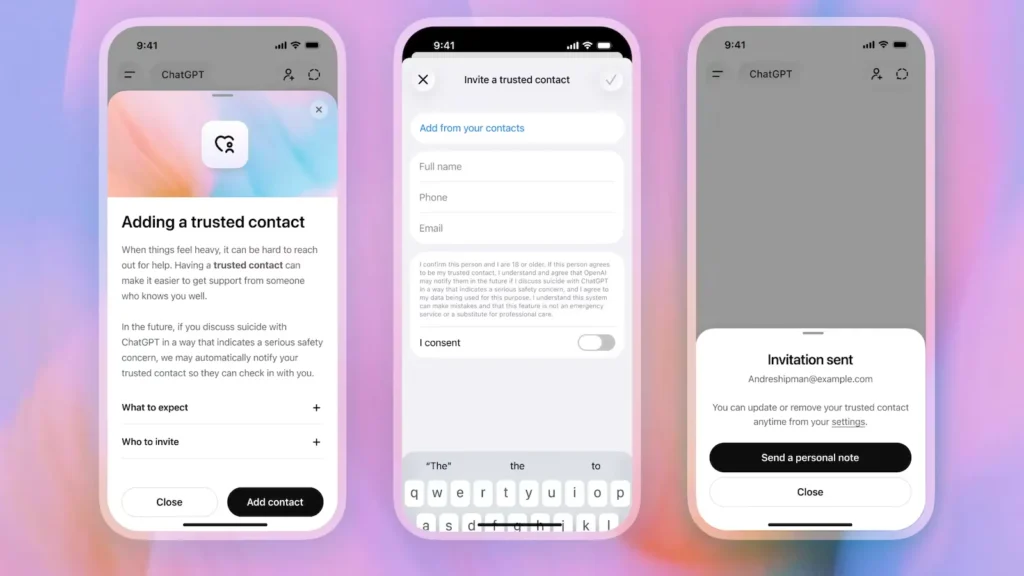

Funksioni i Kontaktit të Besuar është i aktivizuar me zgjedhje. Çdo përdorues i rritur i ChatGPT mund ta aktivizojë atë duke shtuar detajet e kontaktit për një të rritur tjetër (18+ globalisht ose 19+ në Korenë e Jugut) në cilësimet e llogarisë së tij ChatGPT. Kontakti i Besuar duhet ta pranojë ftesën brenda një jave nga marrja e kërkesës. Përdoruesit mund ta heqin ose modifikojnë kontaktin e zgjedhur në cilësime, dhe Kontakti i Besuar gjithashtu mund të zgjedhë të heqë veten në çdo kohë.

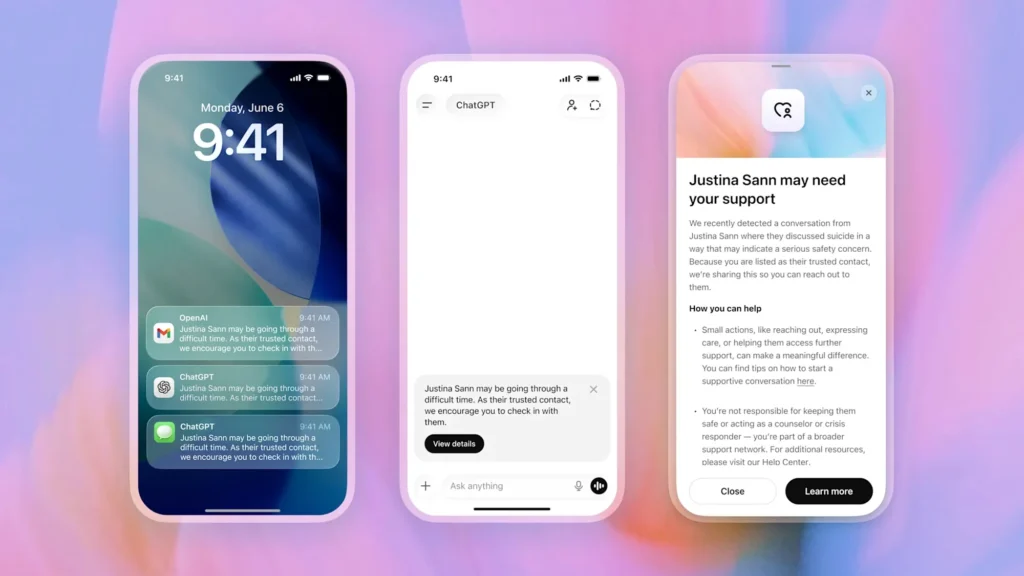

OpenAI thotë se njoftimi është “qëllimisht i kufizuar” dhe nuk do të ndajë detajet e bisedës ose transkriptet me Kontaktin e Besuar. Nëse sistemet e automatizuara të OpenAI zbulojnë se një përdorues po flet për dëmtimin e vetes, ChatGPT do ta inkurajojë përdoruesin të kontaktojë Kontaktin e tij të Besuar për ndihmë dhe ta njoftojë se kontakti mund të njoftohet. Një “ekip i vogël njerëzish të trajnuar posaçërisht” do ta shqyrtojë më pas situatën, sipas OpenAI, dhe ChatGPT do t’i dërgojë një email të shkurtër, mesazh me tekst ose njoftim brenda aplikacionit ChatGPT Kontaktit të Besuar nëse biseda përcaktohet se tregon shqetësime serioze për sigurinë.

Kjo mbështetet në funksionin e kontaktit në rast urgjence që u prezantua së bashku me kontrollet prindërore të ChatGPT në shtator, pasi një 16-vjeçar i mori jetën vetes pas muajsh rrëfimi në ChatGPT. Meta ka prezantuar gjithashtu një funksion të ngjashëm që i njofton prindërit nëse fëmijët e tyre kërkojnë “vazhdimisht” tema për vetëlëndim në Instagram.