CEO i Nvidia parashikon 1 trilion dollarë në shitje të çipave AI ndërsa fillon një epokë e re e kompjuterizimit

Drejtori Ekzekutiv Jensen Huang hapi Epokën e Inferencës në eventin vjetor GTC të kompanisë të hënën, duke përshkruar një gamë të gjerë produktesh të reja, si në harduer ashtu edhe në softuer, të orientuara drejt drejtimit të modeleve të inteligjencës artificiale më shpejt dhe me efikasitet.

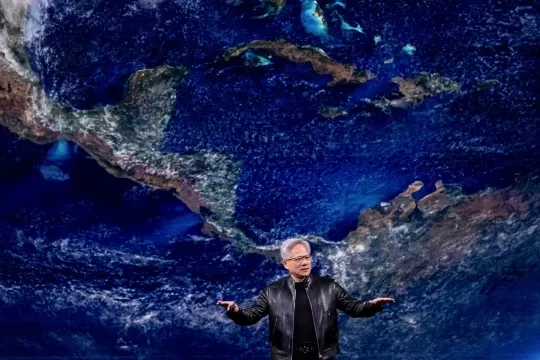

Përpara një turme prej më shumë se 30,000 personash në Qendrën SAP, shtëpia e ekipit të hokejit San Jose Sharks, Huang zbuloi produktin e ri kryesor të Nvidia-s, i cili sipas tij do të revolucionarizonte inferencën, formën e informatikës IA që u lejon modeleve t’u përgjigjen pyetjeve të përdoruesve.

Për vite me radhë, Nvidia ka dominuar biznesin e shitjes së njësive të përpunimit grafik, ose GPU-ve, çipave të fuqishëm që përdoren për të trajnuar shumicën e modeleve të mëdha të IA-së. Por gjatë vitit të kaluar, ndërsa kompanitë e IA-së kanë lëvizur shpejt për të provuar të fitojnë para nga modelet e tyre dhe mjetet e IA-së të ndërtuara mbi to, klientët kanë kërkuar çipa më të mirë që janë të personalizuar për llogaritjen e inferencës, në vend të trajnimit.

Të njohur si rafti Nvidia Groq 3 LPX, serverët e rinj të Nvidia-s do të kombinojnë 72 nga serverët Vera Rubin të gjeneratës së ardhshme të Nvidia-s me 256 të një çipi të ri të quajtur LPU, ose njësi përpunimi gjuhësor, të zhvilluar nga Groq, një startup, ekipi kryesor i të cilit, Nvidia, e bleu në një marrëveshje licencimi teknologjik prej 20 miliardë dollarësh në dhjetor.

“Kjo është e ardhmja e IA-së. Këtu dëshiron të shkojë IA,” tha Huang. “Është projektuar për nxjerrje përfundimesh, kjo ngarkesë pune e vetme. Dhe kjo ngarkesë pune është ajo që i vë në lëvizje fabrikat e IA-së.”

Nvidia tha se ky sistem i ri mund të gjenerojë 700 milionë tokena – njësia bazë e matjeve të llogaritjes – për sekondë, një shpejtësi llogaritjeje që është 350 herë më e shpejtë se gjenerata e parafundit e GPU-ve të Nvidia-s, e njohur si Hopper.

Huang ka sinjalizuar për pjesën më të madhe të vitit të kaluar se Nvidia do të përqendrohet gjithnjë e më shumë në informatikën e inferencës në të ardhmen. GPU-të tradicionale të kompanisë zakonisht nuk janë konsideruar si ideale për inferencë, sepse ato konsumojnë një sasi të madhe energjie dhe nuk vijnë me memorie të mjaftueshme të bashkangjitur për të lejuar modelet të qasen në sasinë e të dhënave mbi të cilat janë trajnuar.

Serverët e rinj të kombinuar Vera Rubin dhe Groq do të kenë 500 herë më shumë memorie me bandwidth të lartë sesa gjenerata Hopper, duke ndihmuar në zgjidhjen e problemit të memories.

“Interpretimi i përfundimeve ka mbërritur,” tha Huang në fjalimin e tij kryesor. “Kjo është sekreti i zgjidhjes.”

Huang tha se Nvidia priste të shiste çipa Blackwell dhe Rubin me vlerë 1 trilion dollarë deri në fund të vitit 2027, duke përditësuar udhëzimet e mëparshme që parashikonin që kompania të shiste çipa me vlerë 500 miliardë dollarë deri në fund të vitit 2026.

Huang e shfrytëzoi fjalimin për të njoftuar një mori partneritetesh që synojnë forcimin e biznesit të Nvidia-s në projektimin e “binjakëve dixhitalë” dhe llojeve të tjera të simulimeve. Kompania njoftoi gjithashtu një koalicion të kompanive të softuerëve, duke përfshirë Cursor, Mistral, Perplexity, Reflection dhe Thinking Machines, që synojnë ta bëjnë më të lehtë zhvillimin e modeleve të inteligjencës artificiale me burim të hapur në nivel të lartë.

Puna e koalicionit do ta vinte në lëvizje të shpejtë zhvillimin e mjeteve softuerike të ndërmarrjeve, tha Huang, duke ndihmuar në përshpejtimin e transformimit të industrisë botërore të softuerëve si shërbim në një industri të inteligjencës artificiale si shërbim agjentësh.

Ndërsa Huang, zëdhënës, Nscale, një startup i cloud computing me bazë në Mbretërinë e Bashkuar i mbështetur nga Nvidia, njoftoi se do të ndërtonte një klaster qendrash të dhënash prej 1.35 gigavatësh në Virxhinian Perëndimore duke përdorur serverat e rinj Vera Rubin. Kompania e përshkruan projektin, të njohur si Monarch Compute Campus, si një nga instalimet më të mëdha të informatikës artificiale në botë.

Nvidia njoftoi gjithashtu një zgjerim të biznesit të saj të drejtimit autonom, duke përfshirë shtimin e disa partnerëve të rinj për sistemin kompjuterik robotaxi të Nvidia-s, duke përfshirë BYD dhe Geely Auto të Kinës dhe Nissan. Duke përdorur çipat dhe modelet e simulimit të Nvidia-s, prodhuesit e automjeteve pritet të rrisin ndjeshëm numrin e automjeteve autonome të ndarjes së udhëtimit në rrugë, tha Huang.

Drejt fundit të prezantimit, një version robotik i Olafit, burrit të dëborës nga seritë e animuara “Frozen” të Disney-t, i projektuar nga një partneritet midis Nvidia-s, DeepMind dhe Disney-t, u ngjit në skenë dhe pati një bisedë të nxehtë me Huang-un rreth divizionit Omniverse të kompanisë, i cili zhvillon produkte fizike të inteligjencës artificiale për gjëra të tilla si robotët.

Ti mësove si të ecësh brenda Omniverse», i tha Huang robotit.

Më pëlqen shumë të ec! u përgjigj me entuziazëm.

A mund ta imagjinosh këtë?» pyeti Huang, përpara se të largohej nga skena. E ardhmja e Disneyland të gjithë këta robotë, të gjithë këta personazhe që enden përreth.