Meta Platforms dërgon pamje private nga syzet AI në Kenya me pak masa mbrojtëse dhe rregullatorët evropianë të privatësisë mund të ndërhyjnë

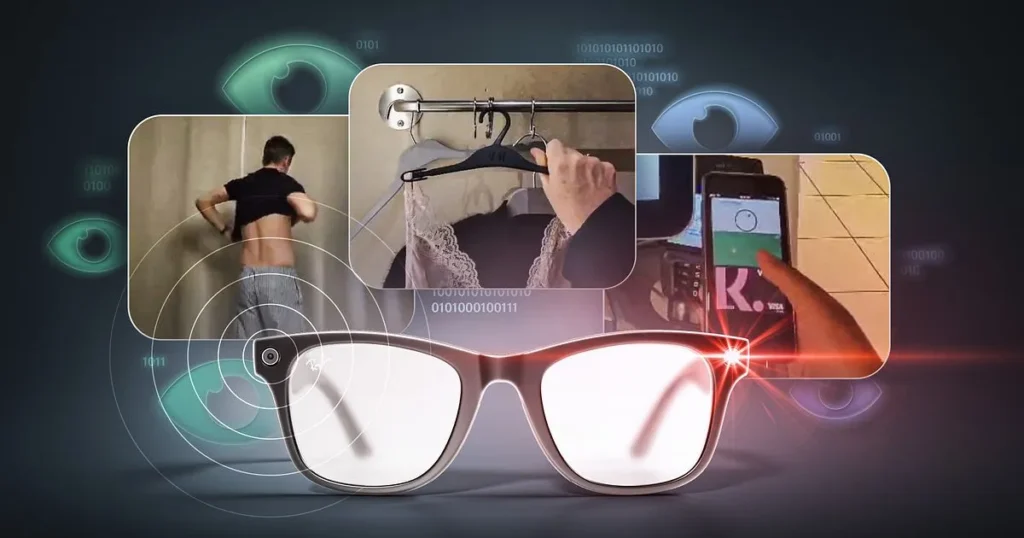

Për të përmirësuar inteligjencën artificiale në syzet inteligjente të Metës, punonjësit e të dhënave në Nairobi shqyrtojnë regjistrimet private. Këto përfshijnë skena nudo, video seksi dhe informacione bankare.

Meta i tregton syzet e saj Ray-Ban në faqen e saj të internetit si një produkt të ndërtuar “duke pasur parasysh privatësinë tuaj”, duke u dhënë përdoruesve kontroll mbi atë që ndahet dhe kur.

Por kushtet e shërbimit për veçoritë e inteligjencës artificiale të syzeve tregojnë një histori tjetër. Ndërsa politika e privatësisë thotë se regjistrimet zanore ruhen vetëm për përmirësime të produktit me pëlqim aktiv, asistenti i inteligjencës artificiale përpunon automatikisht të folurit, tekstin, imazhet dhe ndonjëherë videon për të funksionuar – dhe se të dhënat mund të ndahen me palë të treta. Përdoruesit nuk mund ta çaktivizojnë këtë përpunim.

Sipas një hetimi nga Svenska Dagbladet dhe Goteborgs-Posten, të dhënat video nga syzet e inteligjencës artificiale përfundojnë te shënuesit e të dhënave në Sama, një kompani shërbimesh të dhënash e kontraktuar nga Meta, në Nairobi të Kenias. Punonjësit atje trajnojnë sistemet e inteligjencës artificiale të Metës duke etiketuar, përshkruar dhe kategorizuar objektet në imazhe dhe video.

Ajo që shfaqet në ekranet e tyre shkon përtej videove të Instagram Reels dhe videove familjare. Shumë punonjës u treguan gazetarëve suedezë për klipet video që tregonin njerëz që dilnin nga banjot lakuriq, duke ndërruar rrobat ose duke bërë seks ndërsa syzet ishin në lëvizje. “Ne shohim gjithçka – nga dhomat e ndenjes deri te trupat e zhveshur. Meta ka këtë lloj përmbajtjeje në bazat e të dhënave të saj”, tha një punonjës për mediat suedeze.

Regjistrime të tjera tregojnë karta bankare të filmuara aksidentalisht ose njerëz që shikojnë pornografi ndërsa mbajnë syze. Puna përfshin gjithashtu shqyrtimin e transkriptimeve – anotatorët kontrollojnë nëse asistenti i inteligjencës artificiale është përgjigjur saktë. Duke vepruar kështu, ata thonë se hasin biseda rreth krimeve, protestave dhe përmbajtjes seksuale. “Nuk janë vetëm përshëndetje, mund të jenë edhe gjëra shumë të errëta”, u tha një punonjës hetuesve.

Punëtorët kanë nënshkruar marrëveshje të gjera për moszbulimin e informacionit. Kamerat janë kudo në zyra dhe telefonat personalë ose pajisjet e regjistrimit janë të ndaluara. Kushdo që bën pyetje rrezikon të humbasë punën – dhe me të, shpesh, rrugën e vetme për të dalë nga varfëria, sipas punëtorëve.

Që syzet e Metës të njohin objektet, të kuptojnë të folurit dhe të interpretojnë skenat, njerëzit duhet së pari të përpunojnë të dhënat e papërpunuara.

Ish-punonjësit e Meta-s në SHBA u konfirmuan gazetarëve suedezë se të dhënat e ndjeshme nuk supozohet të përdoren për trajnimin e inteligjencës artificiale. Fytyrat në të dhënat e shënimeve turbullohen automatikisht.

Por anotuesit e të dhënave në Kenia thonë se anonimizimi nuk funksionon gjithmonë. Fytyrat që duhet të errësohen ndonjëherë janë të dukshme. “Algoritmet ndonjëherë dështojnë. Sidomos në kushte të vështira ndriçimi, fytyra dhe trupa të caktuar bëhen të dukshëm”, tha një ish-punonjës i Meta-s.

Kleanthi Sardeli, një avokate e privatësisë së të dhënave në organizatën me seli në Vjenë None Of Your Business (NOYB), e cila ka ngritur padi të shumta kundër Metës, sheh një problem të qartë transparence. Përdoruesit mund të mos e kuptojnë se kamera po regjistron kur flasin me asistentin e inteligjencës artificiale. Natyra e videove të përpunuara nga Sama është një tregues i fortë i kësaj.

“Nëse kjo ndodh në Evropë, mungon si transparenca ashtu edhe një bazë ligjore për përpunimin”, tha ajo për mediat suedeze. Për trajnimin në inteligjencën artificiale duhet të kërkohet pëlqim i qartë. “Pasi materiali të jetë futur në modele, përdoruesi në praktikë humbet kontrollin mbi mënyrën se si përdoret ai.”

Aktualisht nuk ka një vendim të BE-së për mjaftueshmërinë për Kenian. Dialogu midis BE-së dhe Kenias filloi vetëm në maj 2024. Meta deklaron në politikën e saj të privatësisë se të dhënat e përdoruesve transferohen, ruhen dhe përpunohen globalisht sepse “Meta është një kompani që operon globalisht”. Petra Wierup, një avokate në autoritetin suedez të mbrojtjes së të dhënave IMY, e bëri të qartë se nëse Meta është kontrolluesi i të dhënave sipas GDPR-së, mbrojtjet duhet të shtrihen edhe tek nënkontraktorët në vendet e treta dhe nuk mund të dobësohen.

Sama nuk është e panjohur me polemikat. Në vitin 2021, kompania etiketoi dhjetëra mijëra fragmente teksti që përmbanin përshkrime të abuzimit seksual, dhunës dhe gjuhës së urrejtjes në emër të OpenAI. Sipas një hetimi të TIME, punëtorët kenianë paguheshin afërsisht nga 1.32 deri në 2 dollarë në orë në atë kohë. Një punëtor e përshkroi përvojën si “torturë”. Kompania gjithashtu ndihmoi në etiketimin e të dhënave për automjetet autonome dhe ishte e përfshirë në moderimin e përmbajtjes në Facebook.

Pasi raportime të mëtejshme zbuluan trauma në punë dhe sulme të dyshuara sindikale në zyrën e Samës në Nairobi, kompania përfundoi punën e saj të moderimit të përmbajtjes për Meta në vitin 2023 dhe e zhvendosi fokusin e saj në shënimin e të dhënave të shikimit kompjuterik – lloji i saktë i punës që tani lidhet me syzet e inteligjencës artificiale.

Vetë puna e shënimeve mbështetet gjithnjë e më shumë nga inteligjenca artificiale. Për trajnimin e modelit të saj të vizionit kompjuterik SAM 3, Meta zhvilloi një “Motor të Dhënash” ku modelet e inteligjencës artificiale gjenerojnë së pari sugjerime segmentimi, të cilat më pas rishikohen dhe korrigjohen nga shënimuesit njerëzorë dhe të inteligjencës artificiale. Procesi është projektuar për të përshpejtuar ndjeshëm shënimet.

Kompanitë kineze të inteligjencës artificiale po mbështeten gjithashtu te punonjësit e të dhënave të jashtme në Kenia.