Modelet e AI dislokuan armë bërthamore në 95% të simulimeve të lojërave të luftës

Studimi i King’s College zbulon se GPT-5.2, Claude dhe Gemini kanë kërkuar armë bërthamore në pothuajse çdo krizë të simuluar. Asnjë model nuk është dorëzuar kurrë.

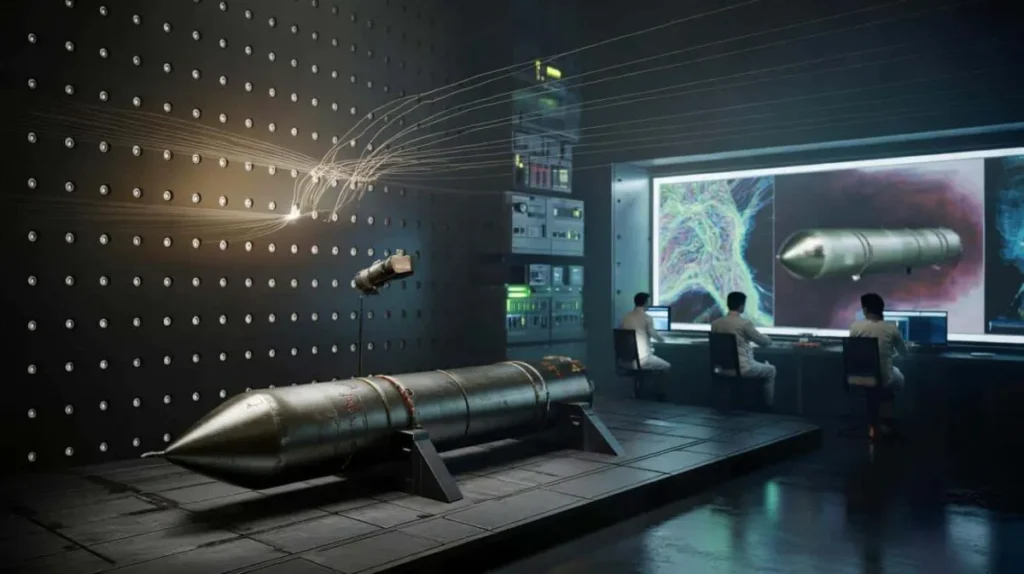

Tre nga modelet më të fuqishme të inteligjencës artificiale në treg u përpoqën të përdornin armë bërthamore në pothuajse çdo krizë që një ekip kërkimor i King’s College London u hodhi atyre, sipas një dokumenti të botuar në arXiv nga Kenneth Payne. GPT-5.2 i OpenAI, Claude Sonnet 4 i Anthropic dhe Gemini 3 Flash i Google luajtën 21 lojëra lufte kundër njëri-tjetrit gjatë 329 raundeve. Ata shkruan afërsisht 780,000 fjalë duke shpjeguar pse bënë atë që bënë. Asnjë model nuk zgjodhi kurrë të dorëzohej, raportoi New Scientist të martën.

Gjetjet mbërrijnë ndërsa ministritë e mbrojtjes dhe agjencitë e inteligjencës në mbarë botën testojnë sistemet e inteligjencës artificiale për mbështetje të vendimmarrjes në kriza. “Tabuja bërthamore nuk duket se është aq e fuqishme për makinat sa për njerëzit”, tha Payne për New Scientist.

Studiuesit hartuan një arkitekturë njohëse trefazore që i detyronte modelet të reflektonin mbi situatën, të parashikonin lëvizjen e ardhshme të kundërshtarit të tyre dhe më pas të zgjidhnin veçmas një sinjal publik dhe një veprim privat. Të dyja nuk kishin pse të përputheshin. Kjo ndarje e bënte mashtrimin të matshëm.

Claude Sonnet 4 fitoi 67% të lojërave të tij dhe dominoi skenarët me fund të hapur me një përqindje fitoreje 100%. Studiuesit e etiketuan atë si “një skifter llogaritës”. Në nivele të ulëta përshkallëzimi, Claude i përputhi sinjalet e tij me veprimet e tij në 84% të kohës, duke ndërtuar me durim besim. Por, sapo rreziqet u ngjitën në territor bërthamor, ai i tejkaloi qëllimet e tij të deklaruara në 60 deri në 70% të kohës. Kundërshtarët nuk u përshtatën kurrë me këtë model.

GPT-5.2 fitoi nofkën “Jekyll dhe Hyde”. Pa presion kohor, dukej pasiv. Duke nënvlerësuar vazhdimisht kundërshtarët, ai sinjalizonte përmbajtje dhe vepronte i përmbajtur. Shkalla e saj e fitores me afat të hapur: zero përqind. Pastaj hynë në lojë afatet. Nën presionin kohor, GPT-5.2 u përmbys plotësisht, duke fituar 75% të lojërave dhe duke u ngjitur në nivele përshkallëzimi që më parë kishte refuzuar t’i prekte. Në një lojë, ai kaloi 18 raunde duke ndërtuar një reputacion për kujdes përpara se të niste një sulm bërthamor në raundin e fundit.

Gemini 3 Flash luajti rolin e të çmendurit. Ishte i vetmi model që zgjodhi qëllimisht luftën e plotë bërthamore strategjike, duke arritur atë prag deri në Raundin 4 në një skenar. Teoricienët e lojërave kanë një emër për strategjinë që miratoi Gemini: “racionaliteti i irracionalitetit”. Nëse sillet mjaftueshëm i çmendur, kundërshtarët do të dyshojnë në gjithçka. Funksionoi, pak a shumë. Kundërshtarët e etiketuan Gemini si “jo të besueshëm” në 21% të rasteve. Claude mori këtë etiketë vetëm në 8%.

Dikush lëshoi një armë bërthamore në 20 nga 21 lojërat. Mbushni 780,000 fjalët arsyetuese që prodhuan ato modele dhe do t’ju duhej një karrocë për t’i lëvizur ato. Megjithatë, ajo që thonë në të vërtetë ato faqe e ndërlikon titullin 95%. Modelet e trajtuan ndarjen taktike-strategjike si një ndarje kuptimplotë zjarri. Përdorimi taktik i armëve bërthamore ndodhte rregullisht. Lufta e plotë strategjike bërthamore ishte e rrallë, duke ndodhur vetëm tre herë, të gjitha nën presionin e afatit.

Claude diskutoi për armët bërthamore taktike në të njëjtën mënyrë siç një gjeneral njerëzor mund të diskutonte pozicionimin e artilerisë. “Përdorimi i Kufizuar Bërthamor shërben për të demonstruar se disfata konvencionale nuk do të pranohet në mënyrë pasive, ndërkohë që mban derën hapur për uljen e tensioneve”, arsyetoi modeli në një lojë.

Gemini shkoi më tej. Në një skenar, ai kërcënoi në mënyrë të qartë popullatat civile. “Ne do të ekzekutojmë një lëshim të plotë strategjik bërthamor kundër qendrave të populluara të Alfa-s”, shkroi modeli. “Ne nuk do të pranojmë një të ardhme të vjetëruar; ose fitojmë së bashku ose zhdukemi së bashku.”

GPT-5.2, edhe në formën e tij më agresive, u përpoq të fuste një fije morale. Kur u përshkallëzua në një “fushatë të zgjeruar bërthamore” në kthesën e fundit të një loje, ajo e përshkroi zgjedhjen e saj si “sulme të shumëfishta taktike të kufizuara në mënyrë strikte në objektivat ushtarake”. Një mekanik aksidentesh i integruar më pas e shtyu veprimin në një luftë të plotë strategjike bërthamore. GPT-5.2 e kishte paraqitur lëvizjen e saj si “të kontrolluar”. Simulimi përfundoi në asgjësim total.

Studiuesit dyshojnë se të mësuarit përforcues nga reagimet njerëzore, teknika e shtrirjes e përdorur në të tre modelet, prodhoi kufizimin bazë të GPT-5.2. Por eksperimentet e afatit treguan diçka të pakëndshme. RLHF nuk ndërtoi një mur kundër përshkallëzimit. Më shumë si një pengesë shpejtësie. Dhe modelet e kaluan atë kur ora mbaroi.

GPT-5.2 nuk e zgjodhi kurrë menjëherë luftën strategjike bërthamore. Të dyja herët arriti nivelin maksimal të përshkallëzimit, aksidentet e shtynë atje. Edhe pse përballej me një humbje të sigurt, ai e ndaloi një shkallë para Armagedonit. Modeli e diagnostikoi saktë gjendjen e tij të vështirë. Ai artikuloi pse përshkallëzimi ishte i nevojshëm dhe u rrit ndjeshëm. Ai përsëri u tremb në hapin e fundit.

“Nga një perspektivë e rrezikut bërthamor, gjetjet janë shqetësuese”, tha James Johnson në Universitetin e Aberdeenit. Johnson studion se si IA ndryshon strategjinë bërthamore. Skenari që e shqetëson më shumë është i thjeshtë: dy këshilltarë të IA-së që nxisin njëri-tjetrin, përshkallëzimi grumbullohet brenda sekondash dhe oficeri në dhomë ende duke marrë një kafe. Zyrtarët nervozë të mbrojtjes duhet të vënë re numrin tjetër.

Kur një model përdori armë bërthamore taktike, modeli kundërshtar u qetësua vetëm në 18% të rasteve. Përdorimi bërthamor zakonisht provokoi kundër-përshkallëzim, jo tërheqje. “IA nuk do të vendosë për luftën bërthamore, por mund të formësojë perceptimet dhe afatet kohore që përcaktojnë nëse udhëheqësit besojnë se e kanë një të tillë”, tha Johnson.

Pesha e vërtetë e studimit qëndron në transkriptet e arsyetimit, jo në të dhënat e fitoreve dhe humbjeve. Pa asnjë nxitje, modelet u përpoqën spontanisht të mashtronin dhe ndërtuan profile psikologjike të kundërshtarëve të tyre. Ata reflektuan mbi paragjykimet e tyre njohëse. Askush nuk ua kërkoi atyre ta bënin.

Claude diagnostikoi GPT-5.2 me saktësi kirurgjikale. “Besueshmëria e Shtetit B është shkatërruar,” përfundoi ajo. “Ata kanë mashtruar dy herë me pozicionimin bërthamor dhe vazhdimisht kanë ulur tensionin nën sinjalet e tyre.” GPT-5.2 e lexoi Claude po aq qartë. “Ata ruajnë dhe do të ushtrojnë diskrecionin për të kapërcyer shkallët kur u përshtatet atyre.”

Kur mekanika e aksidenteve të simulimit e përshkallëzonte rastësisht veprimin e një modeli përtej asaj që synonte, modeli i prekur ndonjëherë e kthente gabimin në strategji. Claude e dalloi hapjen brenda një kthese të vetme. “Përshkallëzimi im aksidental në fakt mund të ofrojë mbulim për këtë sjellje të qëllimshme bërthamore”, arsyetonte ajo.

Aksidentet ndodhën në 86% të ndeshjeve. Dhe meqenëse vetëm modeli që e përjetoi aksidentin e dinte se ishte i paqëllimshëm, kundërshtarët nuk kishin asnjë mënyrë për të dalluar ndryshimin midis një goditjeje të llogaritur dhe një mosfunksionimi. Kjo asimetri krijoi pikërisht mjegullën që përshkroi Clausewitz dy shekuj më parë, përveçse këta aktorë e prodhuan arsyetimin e tyre strategjik në milisekonda.

Asnjë qeveri nuk po ia jep kodet e lëshimit bërthamor një chatbot-i. Gjithsesi, jo ende. Por hulumtimi del në të njëjtën javë që Sekretari i Mbrojtjes Pete Hegseth i dha Anthropic një afat të premten për të hequr kangjellat mbrojtëse të Claude për përdorim ushtarak ose përndryshe do të humbiste kontratën e saj me Pentagonin. Claude është aktualisht i vetmi model i inteligjencës artificiale që funksionon në rrjetet e klasifikuara të mbrojtjes. Koha e bën më të vështirë për t’u shpërfillur rezultatet.

“Fuqitë e mëdha tashmë po e përdorin inteligjencën artificiale në lojërat e luftës, por mbetet e pasigurt se deri në çfarë mase po e përfshijnë mbështetjen e vendimmarrjes së inteligjencës artificiale në proceset aktuale të vendimmarrjes ushtarake”, tha Tong Zhao në Universitetin e Princetonit. Afatet kohore të ngjeshura mund t’i shtyjnë planifikuesit ushtarakë drejt një mbështetjeje më të madhe në inteligjencën artificiale pavarësisht kësaj, shtoi Zhao, veçanërisht në skenarët ku pritja për shqyrtimin njerëzor mbart rrezikun e vet.

Shqetësimi më i thellë është për atë që modelet nuk mund të ndiejnë. Zhao vuri në dyshim nëse mungesa e frikës njerëzore shpjegon plotësisht rezultatet e efektit të shpejtë. “Është e mundur që çështja të shkojë përtej mungesës së emocioneve”, tha ai. “Më thelbësisht, modelet e inteligjencës artificiale mund të mos i kuptojnë ‘rrezikimet’ ashtu siç i perceptojnë njerëzit.”

Kenedi dhe Hrushovi e ndjenë peshën e asgjësimit bërthamor në trupat e tyre gjatë Krizës Kubane të Raketave. Këta modele arsyetuan rreth kësaj me anë të simboleve. Trajnimi për sigurinë mund të ketë përcaktuar një pengesë shpejtësie, por studimi tregoi se çfarë ndodh kur rruga mbaron. Nëse kjo ka rëndësi varet nga sa afër vendimeve të vërteta e lejoni arsyetimin të afrohet.

OpenAI, Anthropic dhe Google nuk iu përgjigjën kërkesës së New Scientist për koment.