OpenAI ndryshon marrëveshjen me Pentagon pas reagimeve kundërshtuese

OpenAI tha këtë fundjavë se arriti një marrëveshje me Pentagonin për të vendosur sisteme të përparuara të inteligjencës artificiale në mjedise të klasifikuara, duke shënuar një zgjerim të ndjeshëm të punës së kompanisë me ushtrinë amerikane.

Njoftimi erdhi më pak se 24 orë pasi administrata Trump e vendosi në listën e zezë Anthropic, duke e përcaktuar firmën rivale të inteligjencës artificiale si një “rrezik për zinxhirin e furnizimit për sigurinë kombëtare” pas një mosmarrëveshjeje mbi gjuhën e kontratës në lidhje me mbikëqyrjen dhe armët autonome.

Presidenti Donald Trump gjithashtu u dha udhëzime agjencive federale që të ndërpresin menjëherë përdorimin e teknologjisë së Anthropic, me Sekretarin e Thesarit Scott Bessent që shkroi të hënën në X se agjencia “po ndërpret të gjithë përdorimin e produkteve Anthropic, përfshirë përdorimin e platformës së saj Claude, brenda departamentit tonë”.

Koha e njoftimeve për IA-në e vuri marrëveshjen e OpenAI nën shqyrtim të rreptë. Në një postim të detajuar në blog, kompania përshkroi ato që i përshkroi si “vija të kuqe” të forta dhe masa mbrojtëse të shtresuara që rregullojnë partneritetin e saj me Pentagonin.

Marrëveshja, siç është paraqitur nga OpenAI, ngre pyetje më të gjera rreth mënyrës se si do të qeverisen sistemet e inteligjencës artificiale në mjediset e sigurisë kombëtare dhe si do të interpretohen dhe zbatohen në praktikë kufizimet e deklaruara të kompanisë.

Postimi në blog i OpenAI hapet me tre angazhime të përcaktuara si të panegociueshme: mospërdorimi i teknologjisë së saj për mbikëqyrje masive vendase, për të drejtuar në mënyrë të pavarur sisteme autonome të armëve ose për vendime të automatizuara me rrezik të lartë, siç është vlerësimi i kreditit social.

Pastaj vjen gjuha aktuale e kontratës — të cilën OpenAI e quan në mënyrë të dukshme “gjuha përkatëse”, jo “marrëveshja e plotë”.

“Departamenti i Luftës mund ta përdorë sistemin e inteligjencës artificiale për të gjitha qëllimet e ligjshme, në përputhje me ligjin në fuqi, kërkesat operacionale dhe protokollet e mirëpërcaktuara të sigurisë dhe mbikëqyrjes”, tha OpenAI.

Kjo është fraza e saktë që Anthropic tha se qeveria e kishte kërkuar gjatë gjithë negociatave. Fraza e saktë me të cilën Anthropic refuzoi të pajtohej. OpenAI e nënshkroi atë, megjithatë argumenton se vijat e saj të kuqe mbeten plotësisht të paprekura.

Megjithatë, “i ligjshëm” në kontekstet e sigurisë kombëtare nuk është një kufi i fiksuar – ai jeton brenda një mozaiku statutesh, urdhrash ekzekutivë, direktivash të brendshme dhe shpesh interpretimesh ligjore të klasifikuara. Kur një kontratë jep “të gjitha qëllimet e ligjshme”, kufiri praktik bëhet zarfi aktual ligjor i qeverisë, jo një standard i pavarur i vendosur nga shitësi.

Dispozita për armët thotë se sistemi i inteligjencës artificiale “nuk do të përdoret për të drejtuar në mënyrë të pavarur armët autonome në asnjë rast kur ligji, rregullorja ose politika e departamentit kërkon kontroll njerëzor”.

Ndalimi zbatohet vetëm aty ku ndonjë autoritet tjetër kërkon tashmë kontroll njerëzor – ai huazon dhëmbët e tij tërësisht nga politika ekzistuese, konkretisht Direktiva e Departamentit të Mbrojtjes 3000.09. Kjo direktivë kërkon që sistemet autonome t’u lejojnë komandantëve të ushtrojnë “nivele të përshtatshme të gjykimit njerëzor mbi përdorimin e forcës”.

Dhe “e përshtatshme” është aq subjektive sa mund të jetë.

Gjykimi njerëzor nuk është kontroll njerëzor. Ky dallim nuk ishte i rastësishëm. Studiuesit e mbrojtjes kanë vënë në dukje se lënia jashtë e gjuhës “njeriu në ciklin e punës” ishte e qëllimshme, pikërisht për të ruajtur fleksibilitetin operacional.

Kundërargumenti më i fortë i OpenAI është arkitektura e saj e vendosjes vetëm në cloud – sythet e vendimmarrjes vdekjeprurëse plotësisht autonome do të kërkonin vendosje në skajet e fushës së betejës, gjë që kjo kontratë nuk e lejon. Ky është një kufizim i vërtetë teknik.

Por inteligjenca artificiale e bazuar në cloud mund të kryejë ende identifikimin e objektivave, analizën e modelit të jetës dhe planifikimin e misionit. Këto janë aktivitete zinxhir vrasësish pavarësisht se ku ndodhet shkaktari përfundimtar. Rezultati për një objektiv nuk ndryshon në bazë të serverit në të cilin funksionon modeli.

Klauzola e mbikëqyrjes ndjek një model të ngjashëm. Vija e kuqe e deklaruar e OpenAI: asnjë mbikëqyrje masive vendase. Gjuha e kontratës: Sistemi “nuk do të përdoret për monitorim të pakufizuar të informacionit privat të personave amerikanë në përputhje me këto autoritete” – pastaj rendit Amendamentin e Katërt, FISA-n dhe Urdhrin Ekzekutiv 12333.

Fjala “i pakufizuar” nënkupton se një version i kufizuar i mbikëqyrjes masive do të ishte i lejueshëm. Dhe EO 12333 është urdhri ekzekutiv që NSA ka përdorur për të justifikuar përgjimin e komunikimeve të amerikanëve kur bëhet jashtë kufijve të SHBA-së.

Dhe këtu bëhen të dukshme shqetësimet e Anthropic në lidhje me formulimin gjatë gjithë negociatave. Argumenti i Anthropic ishte se ligji aktual nuk ka arritur atë që bën të mundur inteligjenca artificiale. Qeveria mund të blejë ligjërisht sasi të mëdha të të dhënave të agreguara tregtare rreth amerikanëve pa një urdhër – dhe e ka bërë tashmë këtë.

Gjuha e kontratave të OpenAI, duke i ankoruar mbrojtjet e saj në kornizat ligjore ekzistuese, mund të mos e mbyllë boshllëkun për të cilin Anthropic ishte në të vërtetë i shqetësuar.

Të shtunën në mbrëmje, Altman mbajti një takim të AMA-s duke iu përgjigjur mijëra pyetjeve në lidhje me marrëveshjen. Kur u pyet se çfarë do ta bënte OpenAI të tërhiqej nga një partneritet qeveritar, ai u përgjigj: “Nëse do të na kërkohej të bënim diçka jokushtetuese ose të paligjshme, ne do të tërhiqeshim.”

Ky formulim e vendos kufirin e OpenAI te ligjshmëria – jo te një gjykim i pavarur etik në lidhje me atë që kompania do të lejojë ose nuk do të lejojë nëse ndodh të jetë e ligjshme, gjë që mbron Anthropic. I pyetur nëse shqetësohej për mosmarrëveshjet e ardhshme mbi atë që konsiderohet “e ligjshme”, ai e pranoi rrezikun: “Nëse na duhet ta marrim përsipër atë betejë, do ta bëjmë, por kjo na ekspozon qartë ndaj një farë rreziku.”

Lidhur me arsyen pse OpenAI arriti një marrëveshje ku Anthropic nuk mundi, Altman ofroi këtë: “Anthropic dukej më i përqendruar në ndalime specifike në kontratë, sesa në citimin e ligjeve në fuqi, me të cilat ndiheshim rehat. Unë do të preferoja qartë të mbështetesha në mbrojtje teknike nëse do të më duhej të zgjidhja vetëm një. Mendoj se Anthropic mund të ketë dashur më shumë kontroll operacional sesa ne.”

Ky është një ndryshim thelbësor filozofik. Anthropic argumentoi se, për shkak se modelet kufitare mund të ripërdoren për inteligjencën dhe rrjedhat e punës ushtarake në mënyra që janë të vështira për t’u parashikuar, kufizimet duhet të jenë të qarta dhe detyruese me shkrim, madje edhe me koston e marrëveshjes. Qëndrimi i OpenAI është se arkitektura teknike, personeli i integruar dhe ligji ekzistues së bashku përbëjnë një mbrojtje më të fortë sesa teksti kontraktual vetëm.

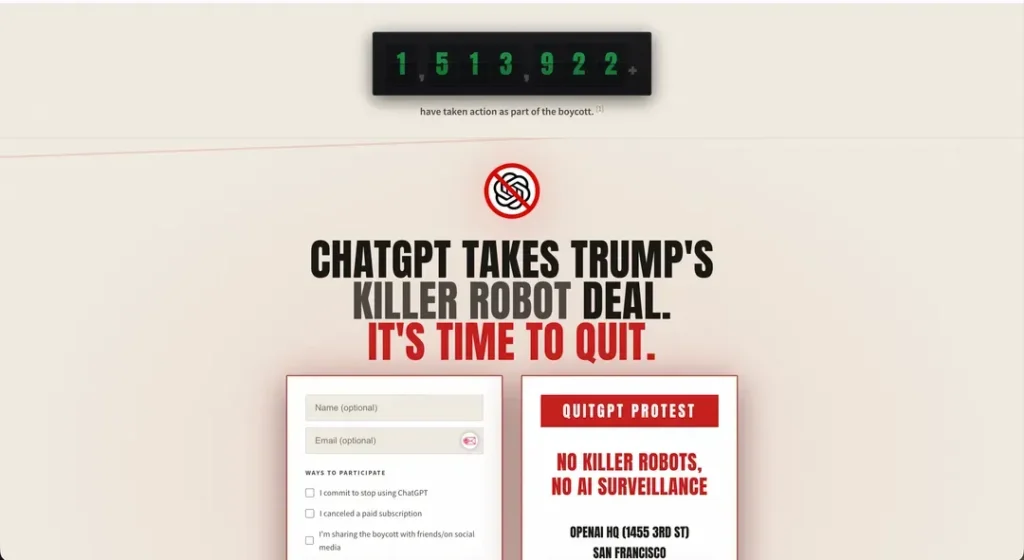

Reagimi ishte i menjëhershëm. Deri të hënën, lëvizja “ QuitGPT ” pretendoi se mbi 1.5 milion njerëz kishin ndërmarrë veprime – duke anuluar abonimet, duke ndarë postime bojkoti ose duke u regjistruar në quitgpt.org.

Fushata e paraqiti veprimin e OpenAI si prioritizim të kontratave ushtarake mbi sigurinë e përdoruesit, duke akuzuar kompaninë se kishte rënë dakord ta lejonte Pentagonin të përdorte teknologjinë e saj për “çdo qëllim të ligjshëm, duke përfshirë robotët vrasës dhe mbikëqyrjen masive”.

OpenAI mund ta kundërshtojë këtë karakterizim. Por tregu lëvizi pavarësisht kësaj.

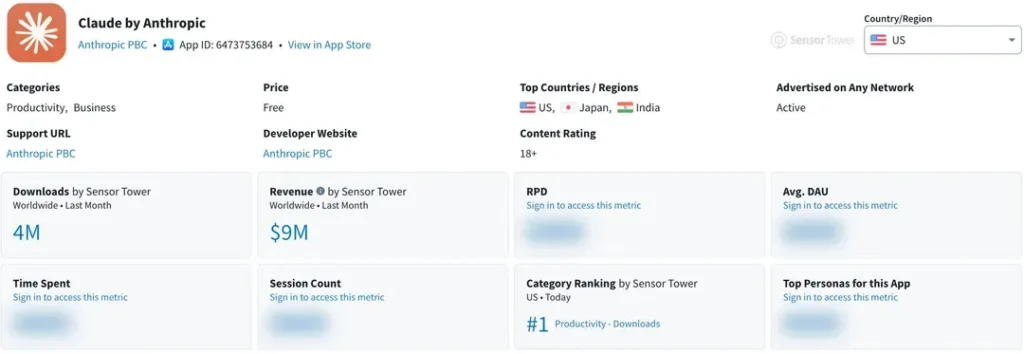

Claude i Anthropic kaloi ChatGPT duke u bërë aplikacioni falas më i shkarkuar në Shtetet e Bashkuara në App Store të Apple, me kompaninë që i tha Decrypt se pati regjistrime rekord ditore gjatë fundjavës.

Ylli i muzikës pop, Katy Perry, ndau një pamje të ekranit të faqes së çmimeve të Claude në X. Qindra përdorues dokumentuan anulimet e abonimeve të tyre publikisht në Reddit. Grafite që lavdëronin Anthropic u shfaqën jashtë zyrave të saj në San Francisko, ndërsa sulmet me shkumës mbuluan trotuaret e OpenAI. Madje edhe qindra punonjës të OpenAI kishin nënshkruar më parë një letër të hapur duke mbështetur refuzimin e Anthropic për t’u pajtuar me kërkesat e Pentagonit.

Korniza e QuitGPT është emocionalisht bindëse, por jo plotësisht e saktë. Vetë Anthropic ka një partneritet me Palantir dhe Amazon Web Services që u jep agjencive të inteligjencës amerikane dhe departamenteve të mbrojtjes qasje në modelet Claude, dhe dyshohet se është përdorur në operacione ushtarake për të përmbysur qeveritë e Venezuelës dhe Iranit. Etika e inteligjencës artificiale dhe kontraktimit të sigurisë kombëtare nuk ka qenë kurrë e pastër nga asnjëra palë.

Ajo që fushata kapi me saktësi është se një segment i madh përdoruesish besonin se kishte një ndryshim domethënës midis mënyrës se si dy kompanitë i përcaktonin kufijtë e tyre – dhe se si votonin me abonimet e tyre.

Nëse ky ndryshim është aq domethënës sa duket, kërkohet leximi me kujdes i kontratës.