“Microsoft Copilot është vetëm për qëllime argëtimi”: Edhe kushtet dhe termat zyrtare të Microsoft thonë se në të vërtetë nuk duhet ta përdorni AI-në e saj në punë

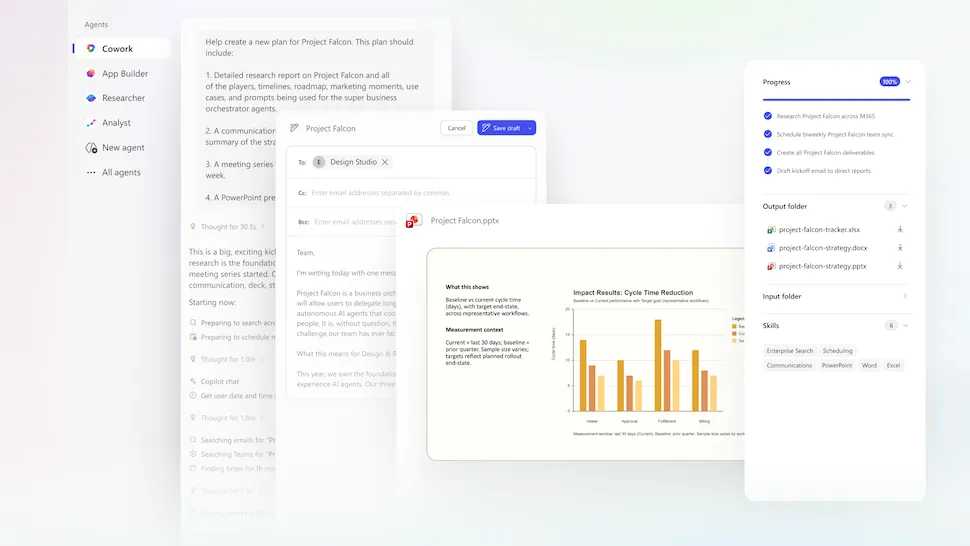

Në një kthesë të madhe ngjarjesh, Microsoft ka riafirmuar se Copilot është vetëm për qëllime argëtimi dhe se, nëse përdoret për punë, duhet të përdoret si faza e parë e shumëfishtë e verifikimit të fakteve, në vend që të mbështetet vetëm tek ai.

“Mund të bëjë gabime dhe mund të mos funksionojë siç është menduar,” shkroi kompania. “Mos u mbështetni te Copilot për këshilla të rëndësishme. Përdoreni Copilot me rrezikun tuaj.”

Edhe pse kompania dëshiron shumë që bizneset dhe punonjësit të vazhdojnë të përdorin Copilot për punë, ka një zhvendosje të qartë të përgjegjësisë ndaj përdoruesit këtu, duke e liruar Microsoft-in nga çdo akuzë për informacion të rremë.

Në një mënyrë të tërthortë, Microsoft po e pranon në mënyrë efektive rrezikun e halucinacioneve të inteligjencës artificiale mes shqetësimeve të vazhdueshme në lidhje me përmbajtjen e mbrojtur me të drejta autoriale, paqartësinë e IP-së dhe legjitimitetin e rezultateve.

Duke pasur parasysh këtë, kompania dëshiron qartë që ne ta konsiderojmë Copilot si një mjet, jo si një vendimmarrës, dhe që përdoruesit të verifikojnë në mënyrë të pavarur rezultatet dhe të jenë të kujdesshëm me çdo të dhënë të ndjeshme dhe të mbrojtur.

“Ju pranoni të na dëmshpërbleni dhe të na lironi të padëmshëm… nga dhe kundër çdo pretendimi, humbjeje dhe shpenzimi… që rrjedh nga ose lidhet me përdorimin tuaj të Copilot,” shtoi Microsoft në një paragraf tjetër.

Në një kuptim më të gjerë, kompania vëren gjithashtu se kërkesat dhe përgjigjet mund të përdoren për të përmirësuar Copilot, megjithatë versionet e ndërmarrjeve kanë mbrojtje shtesë për të mbrojtur informacionin e ndjeshëm. Me fjalë të tjera, përdoruesit ruajnë të drejtat për të dhënat e tyre, megjithatë Microsoft ende ka të drejtë të përdorë të dhënat për përmirësimin e shërbimit.

Megjithatë, ndërsa përpjekjet e Microsoft për t’u ngarkuar përdoruesve një pjesë të përgjegjësisë kanë rënë në qendër të vëmendjes, nuk është e vetmja kompani me kushte të tilla. OpenAI, Google dhe Anthropic shprehin këshilla të ngjashme në kushtet e tyre, duke përfshirë përgjegjësinë e përdoruesit dhe asnjë garanci për saktësi.

Zhvendosja e përgjegjësisë nga shitësi i inteligjencës artificiale te përdoruesi është një ndryshim i vazhdueshëm që kompanitë po e pohojnë, ndërsa industria ende po përcakton se cilat mund të jenë rreziqet ligjore, por meqenëse Microsoft ende shet mjete Copilot për përdoruesit e biznesit dhe konsumatorët, është qartësisht një ushtrim riformulimi i termit sesa një ndryshim total në sjellje.