Google prezanton TurboQuant, një algoritëm të ri për kompresimin e memories në AI — dhe po, interneti po e quan “Pied Piper”

Nëse studiuesit e inteligjencës artificiale të Google do të kishin sens humori, ata do ta kishin quajtur TurboQuant, algoritmin e ri ultra-efikas të kompresimit të kujtesës së inteligjencës artificiale të njoftuar të martën, “Pied Piper” – ose, të paktën kështu mendon interneti.

Shakaja është një referencë për startup-in fiktiv Pied Piper, i cili ishte në qendër të serialit televiziv “Silicon Valley” të HBO-së që u transmetua nga viti 2014 deri në vitin 2019.

Shfaqja ndoqi themeluesit e startup-it ndërsa ata lundronin në ekosistemin teknologjik, duke u përballur me sfida si konkurrenca nga kompanitë më të mëdha, mbledhja e fondeve, problemet me teknologjinë dhe produktet, dhe madje ( për kënaqësinë tonë të madhe) duke i mahnitur gjyqtarët me një version fiktiv të TechCrunch Disrupt.

Teknologjia revolucionare e Pied Piper në shfaqjen televizive ishte një algoritëm kompresimi që uli shumë madhësinë e skedarëve me kompresim pothuajse pa humbje. TurboQuant i ri i Google Research ka të bëjë gjithashtu me kompresimin ekstrem pa humbje të cilësisë, por i aplikuar në një pengesë thelbësore në sistemet e inteligjencës artificiale. Prandaj, krahasimet.

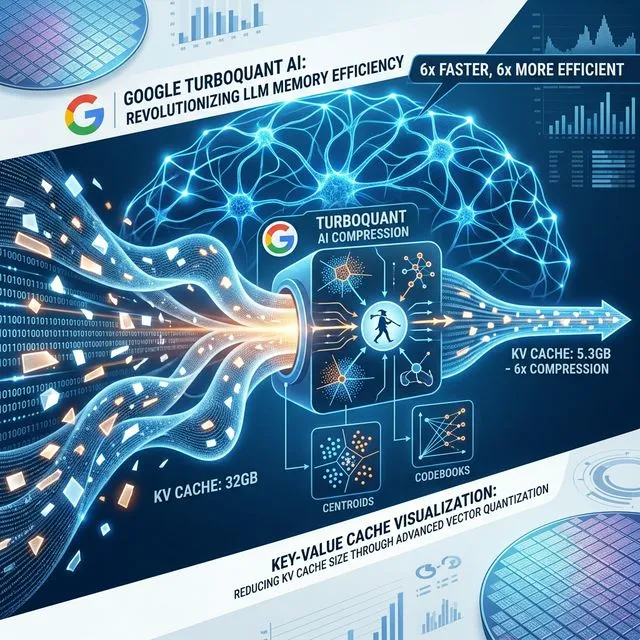

Google Research e përshkroi teknologjinë si një mënyrë të re për të zvogëluar kujtesën e punës së IA-së pa ndikuar në performancë. Metoda e kompresimit, e cila përdor një formë të kuantizimit vektorial për të pastruar pengesat në memorien e përkohshme (cache) në përpunimin e IA-së, në thelb do t’i lejonte IA-së të mbante mend më shumë informacion duke zënë më pak hapësirë dhe duke ruajtur saktësinë, sipas studiuesve.

Ata planifikojnë të paraqesin gjetjet e tyre në konferencën ICLR 2026 muajin e ardhshëm, së bashku me dy metodat që po e bëjnë të mundur këtë kompresim: metoda e kuantizimit PolarQuant dhe një metodë trajnimi dhe optimizimi e quajtur QJL.

Të kuptuarit e matematikës së përfshirë këtu është diçka që studiuesit dhe shkencëtarët e kompjuterave mund të jenë në gjendje ta bëjnë, por rezultatet janë emocionuese për industrinë më të gjerë të teknologjisë në tërësi.

Nëse zbatohet me sukses në botën reale, TurboQuant mund ta bëjë IA-në më të lirë për t’u përdorur duke zvogëluar “memorjen e punës” të kohës së ekzekutimit – e njohur si memoria e përkohshme KV – me “të paktën 6 herë”.

Disa, si CEO i Cloudflare, Matthew Prince, madje po e quajnë këtë momentin DeepSeek të Google-it — një referencë për fitimet në efikasitet të nxitura nga modeli kinez i inteligjencës artificiale, i cili u trajnua me një kosto shumë më të ulët se rivalët e tij në çipa më të këqij, ndërkohë që mbeti konkurrues në rezultatet e tij.

Megjithatë, vlen të përmendet se TurboQuant ende nuk është vendosur gjerësisht; për momentin është ende një përparim në laborator.

Kjo i bën krahasimet me diçka si DeepSeek, apo edhe me Pied Piper fiktiv, më të vështira. Në TV, teknologjia e Pied Piper do të ndryshonte rrënjësisht rregullat e informatikës. Ndërkohë, TurboQuant mund të çonte në rritje të efikasitetit dhe sisteme që kërkojnë më pak memorie gjatë nxjerrjes së përfundimeve. Por kjo nuk do të zgjidhte domosdoshmërisht mungesat më të gjera të RAM-it të shkaktuara nga inteligjenca artificiale, duke qenë se ajo synon vetëm memorien e nxjerrjes së përfundimeve, jo trajnimin – ky i fundit vazhdon të kërkojë sasi të mëdha RAM-i.