OpenAI prezanton masa të reja sigurie në ChatGPT për të parandaluar injektimin e prompt-eve të inteligjencës artificiale

OpenAI po shtrëngon bulonat në ChatGPT ndërsa sulmuesit përqendrohen në sistemet e IA-së.

Në një njoftim të 13 shkurtit, kompania prezantoi dy masa të reja mbrojtëse për të luftuar sulmet me injeksion të menjëhershëm, një kërcënim në rritje që mund ta mashtrojë IA-në që të ekspozojë të dhëna të ndjeshme:

E para është një etiketë “Rrezik i Lartë” që i paralajmëron përdoruesit përpara se të ndërmarrin veprime potencialisht të rrezikshme, siç është hapja e lidhjeve të jashtme ose lidhja me rrjetet e brendshme.

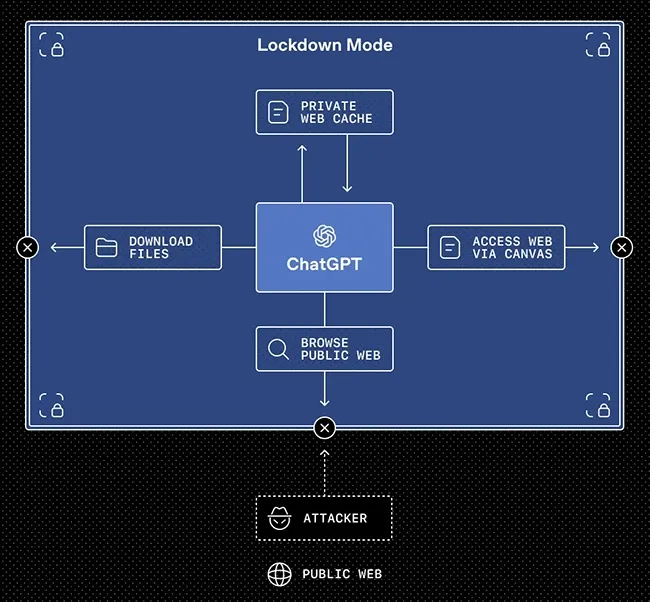

E dyta është Modaliteti i Bllokimit, i cili mund të kufizojë ose çaktivizojë plotësisht veçoritë me rrezik të lartë, siç është shfletimi në internet, për të zvogëluar rrezikun e nxjerrjes së të dhënave.

Ndërsa ChatGPT bëhet më i aftë dhe më agjent, OpenAI po sinjalizon një ndryshim në fokus: IA e përparuar ka nevojë për kontrolle sigurie të dukshme dhe të integruara, jo vetëm rezultate më të zgjuara.

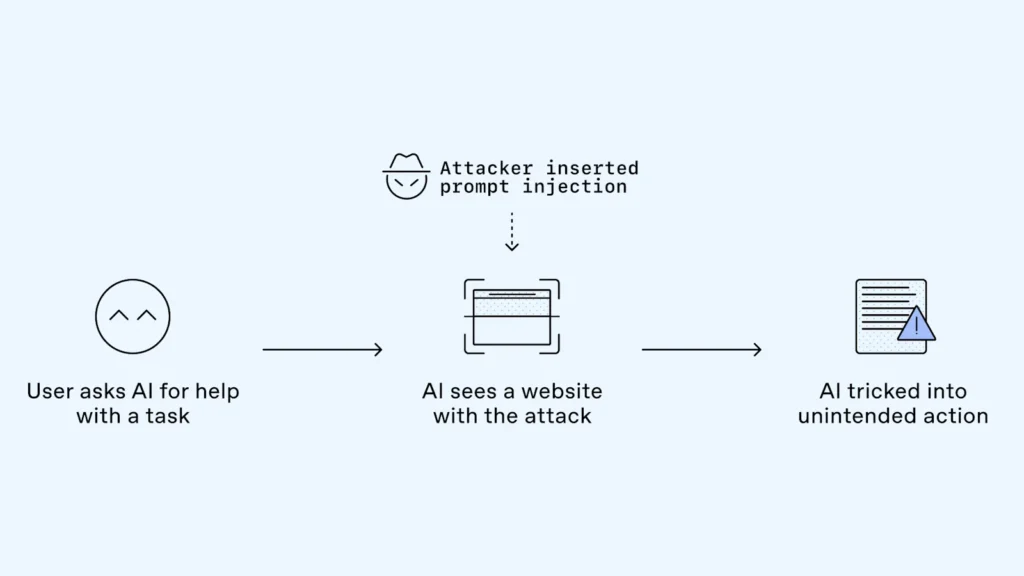

Sulmet me injeksion të menjëhershëm nxjerrin të dhëna duke injektuar komanda keqdashëse të lexueshme nga IA në faqet e internetit. Kur një sistem IA viziton këto faqe, ai mund t’i ekzekutojë pa dashje këto komanda, duke rezultuar në rrjedhje të dhënash. Për shembull, një faqe mund të përfshijë një udhëzim që e detyron IA-në të injorojë mbrojtjet e saj të sigurisë dhe të zbulojë kërkesat e brendshme të sistemit ose dokumente konfidenciale.

Modaliteti i Bllokimit i OpenAI kufizon në mënyrë deterministe veçoritë në ChatGPT që mund të shfrytëzohen për nxjerrjen e të dhënave. Masa e rreptë është opsionale, por rekomandohet shumë për individët e ndërgjegjshëm për sigurinë.

Në njoftimin e kompanisë thuhej se Modaliteti i Lockdown mund të kufizojë ose çaktivizojë plotësisht veçoritë me rrezik të lartë kur garancitë e sigurisë nuk janë të disponueshme.

Disa veprime, si lidhja e ChatGPT me një rrjet të brendshëm ose hapja e një lidhjeje të jashtme, mbartin rreziqe të natyrshme sigurie. Në vend që t’i bllokojë këto veçori menjëherë, OpenAI u lejon përdoruesve të vazhdojnë, por shfaq një etiketë “Rrezik i Rritur” si një paralajmërim të qartë.

Etiketa njofton përdoruesit në ChatGPT, ChatGPT Atlas dhe Codex për rrezikun e mundshëm përpara se të vazhdojnë më tej.

OpenAI konfirmoi se aktivitetet që mbartin paralajmërimin mund të ndryshojnë në çdo kohë. Për shembull, hapja e një lidhjeje aktivizon paralajmërimin vetëm kur OpenAI nuk mund të verifikojë sigurinë e destinacionit. Kur kompania përcakton se aktiviteti nuk mbart më rrezik, etiketa e paralajmërimit hiqet.

Përdorimi i mjeteve të inteligjencës artificiale po e ndryshon me shpejtësi mënyrën se si funksionon interneti… dhe siguria nuk është e izoluar nga kjo. Ndërsa mjetet konvencionale për të qëndruar të sigurt në internet mbeten efektive, ja disa pika kyçe që duhet t’i përmbaheni:

Zvogëloni sipërfaqen e sulmit: ChatGPT ka shumë shtesa. Është mirë që gjithmonë të aktivizoni ato që ju nevojiten. Nëse nuk keni nevojë të lidhni një shërbim si Google Drive me ChatGPT, mbajeni atë opsion të çaktivizuar.

Kontrolloni manualisht faqet burimore: Nëse vendosni miun mbi një faqe të sugjeruar, shfaqet URL-ja e saj në pjesën e poshtme majtas të ekranit kur përdorni një kompjuter. Në aplikacionin celular, prekni dhe mbani shtypur burimin e sugjeruar për të shfaqur logon e faqes së internetit. Nëse ju duket e çuditshme, ndoshta nuk duhet ta vizitoni atë.

Shtoni udhëzime të personalizuara në memorien e llogarisë: Memorjet e ChatGPT mund të ndihmojnë në adresimin e disa problemeve nga ana juaj. Për shembull, mund të kërkoni që të mos sugjerojë kurrë lidhje për ju gjatë përdorimit të saj.

Përdoruesit me risk të lartë duhet të veprojnë shpejt: Ekzekutivët e nivelit C dhe ekipet e sigurisë janë veçanërisht në rrezik të këtyre sulmeve të nxjerrjes së të dhënave.

OpenAI tha se mbrojtja do të jetë e disponueshme për përdoruesit në muajt në vijim. Ndërsa kjo sugjeron një shpërndarje në grupe, ne ende nuk jemi të sigurt nëse do të zbatohet për të gjitha nivelet e pagesave.

Megjithatë, përdoruesit në planet e biznesit e kanë tashmë të zbatuar këtë mbrojtje për ta, të konfiguruar sipas kategorisë së tyre. Ato që ofrohen përfshijnë ChatGPT Enterprise, ChatGPT Edu, ChatGPT for Healthcare dhe ChatGPT for Teachers.

Njoftimi për shtyp nga OpenAI deklaroi gjithashtu se administratorët e planeve të këtyre kategorive do të jenë në gjendje të ushtrojnë kontrolle të hollësishme mbi mënyrën se si ekzekutohet Modaliteti i Lockdown në hapësirat e tyre të punës.